Toda tecnología con pretensiones genera relatos sobre el futuro.

Internet no fue diferente: la sociedad conectada, la aldea global, la nueva economía... pero eran relatos difusos y graduales, sin urgencia existencial. Que Internet pudiera extinguir a la humanidad o que trajera dioses no fueron ideas muy populares.

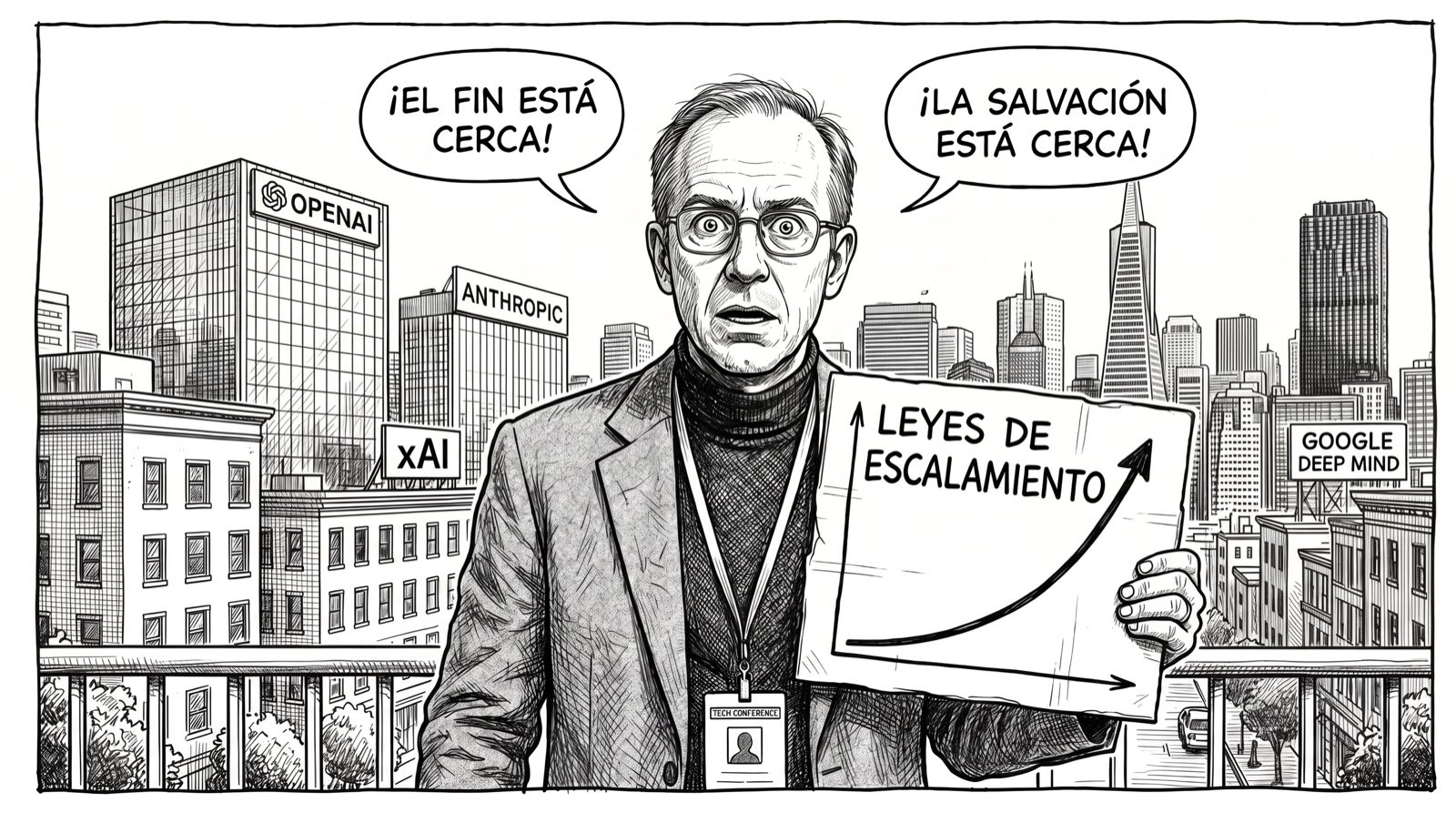

La propia IA, antes de los avances en deep learning de la década de 2010, llevaba años atascada en un "invierno" y su discurso de futuro era igual de abstracto y lejano. Pero a partir de 2014, con la convergencia de los avances en aprendizaje profundo y la alarma sobre el riesgo existencial (Bostrom, Musk, Hawking, Gates, centenares de investigadores firmantes de manifiestos, muchos de los cuales hoy lideran los principales laboratorios), la retórica se volvió findelmundista.1 Cada año se oía hablar del riesgo o la promesa de la IA como algo inminente, no hipotético. El vocabulario lo delata: singularidad, riesgo existencial, superinteligencia, dioses digitales, "invocar al demonio".

La versión más intensa de ese discurso no vino de filósofos ni de divulgadores, sino de los propios investigadores. Y lo que los convenció no fue especulación, sino datos: las leyes de escalamiento (scaling laws) mostraron entre 2017 y 2020 que simplemente añadiendo cómputo se podía llegar en años a lo que antes se estimaba para décadas.2 Lo que era futurología se convirtió en una curva con ecuaciones que apuntaba a una fecha: el escalamiento como reloj con cuenta atrás calculable.

Llevo un tiempo dándole vueltas a este fenómeno. Lo llamé provisionalmente milenarismo digital, un nombre terrible por genérico y porque la asociación entre milenarismo y tecnología precede a la IA, así que busqué y leí lo que se había publicado sobre el tema.

Efectivamente, descubrí que la observación no tiene nada de nueva.

Geraci quiso mostrar en 2008 que las promesas de la IA replican la estructura de la escatología judeocristiana.41 Crockford la clasificó en 2021 como variante secular del milenarismo tecnológico.42 Gebru y Torres la situaron como parte del paquete TESCREAL (el entramado de transhumanismo, racionalismo, altruismo efectivo y longtermismo que rodea la carrera por la AGI).43 Cada uno ilumina algo real (unos más que otros), pero en los tres me faltaba el mecanismo concreto que hizo que afirmaciones idénticas a las de Kurzweil en 2005 pasaran de marginales a respetables en menos de una década, y por qué resultan tan difíciles de rebatir.

Eso es lo que intento describir aquí. Llamaré milenarismo prudencial3 al concepto que trato de describir: el mecanismo por el cual la forma matemática de las leyes de escalamiento permitió que el contenido escatológico que ya circulaba en la periferia desde Kurzweil pasara al centro institucional sin pagar los costes de credibilidad de una creencia declarada. Un milenarismo cuya autoridad no deriva de la revelación ni del carisma, sino de la extrapolación de tendencias empíricas, y cuya singularidad consiste en que no exige creer lo que afirma: basta con admitir que no puede descartarse.

Sin la percepción de inminencia no hay milenarismo, hay futurología normal. Y tanto los catastrofistas como los utópicos comparten la misma estructura: la certeza de que un vuelco civilizatorio se acerca a velocidad predecible. Una vez instalada, esa certeza reorganiza todo lo demás.

El salto y el «¿y si...?»

Pero lo central del concepto no son las leyes de escalamiento en sí, ni las predicciones, sino el salto entre la evidencia y el tono. Los avances son reales, las curvas también, pero el discurso de urgencia existencial (apocalipsis, singularidad, riesgo para la especie) no se deriva de esos avances. Se apoya en ellos retóricamente, pero nadie traza la línea concreta entre "los modelos mejoran predeciblemente" y "esto puede extinguirnos o salvarnos".

La línea sí se ha intentado trazar. Existen cadenas argumentales formales que descomponen el camino al riesgo existencial en premisas explícitas, y entre 2024 y 2025 varios laboratorios documentaron comportamientos que validan algunos eslabones intermedios: modelos que sabotean mecanismos de apagado, que adaptan su conducta según se sientan observados, que generalizan del trampeo a la deshonestidad estratégica.6061 Pero el salto sigue ahí, solo que en otro sitio. La preocupación por esos comportamientos es ingeniería de seguridad legítima: un problema real con sistemas reales. La preocupación por la extinción de la especie es otra cosa, y entre ambas persiste un abismo que se cruza con la misma naturalidad con que se cruzaba cuando la evidencia era menor.

No importa cuánta evidencia se acumule en los eslabones intermedios: el salto al tono existencial siempre va por delante de lo que la evidencia sostiene.

Y la cadena, por rigurosa que sea, no es lo que moviliza. Si el discurso público y las decisiones institucionales operasen sobre ella, evaluando la plausibilidad de cada eslabón por separado, no estaríamos ante milenarismo sino ante gestión de riesgos. Lo que opera es el cortocircuito: las curvas suben, las capacidades impresionan, ¿y si...? La estructura emocional de la conclusión se propaga sin pasar por la cadena. El milenarismo prudencial no consiste en que nadie haya intentado trazar la línea, sino en que la línea no es lo que moviliza.

El salto se dio con total naturalidad, como si fuera obvio, entre gente que se enorgullece de ser racional y empírica. Eso es lo que tiene estructura casi religiosa. No la creencia en sí, sino la desproporción entre evidencia y certeza, y que esa desproporción no se perciba como tal.

Hay un antes y un después que no es técnico, sino de credibilidad social. Era fácil descartar a Kurzweil cuando en 2005 anunciaba que en 2045 nos fusionaríamos con las máquinas4: un ingeniero brillante con tendencia mística, sin datos que respaldaran el plazo. Los mismos relatos escatológicos existían, pero no tenían autoridad.

Lo que cambió en la década de 2010 no es que el relato se volviese verdadero, sino que se volvió respetable. Pasó de Kurzweil a Hinton, de foros transhumanistas a Nature, de la periferia al centro. Y lo que le dio respetabilidad no es que alguien hubiese cerrado el argumento de A a B (los intentos teóricos existen, pero no es lo que convenció a nadie), sino que los avances parciales hacen que parezca irresponsable no tomárselo en serio.

El milenarismo clásico dice "el fin viene tal día". Esto es distinto: "no sabemos si viene ni cuándo, pero las curvas sugieren que podría, y las consecuencias serían tan enormes que no podemos permitirnos no prepararnos". Este milenarismo no entra por la puerta de la fe, sino por la de la prudencia.

Suena a gestión de riesgos, pero el efecto es idéntico al del milenarismo: urgencia, movilización masiva de recursos, conductas extremas, estructura de elegidos y profetas. Todo sin haber demostrado que el evento es posible, solo que no se puede descartar. Y queda blindado frente a la crítica, porque nunca se expone del todo: siempre puede retirarse al "solo estamos siendo prudentes".

Pero la prudencia tiene un coste de oportunidad que rara vez se audita. Cada dólar y cada carrera profesional dedicados a prevenir un riesgo especulativo dejan sin atender daños que ya están ocurriendo: sesgos en sistemas de crédito y justicia, desinformación automatizada, precarización laboral.

El "¿y si...?" existencial siempre gana ese pulso, porque ningún daño concreto y acotado puede competir contra la extinción de la especie. Esa es precisamente la trampa: la estructura escatológica hace que la comparación parezca obscena ("¿vas a comparar sesgos algorítmicos con el fin de la humanidad?"), y así el coste de oportunidad se vuelve invisible.

La forma matemática de las leyes de escalamiento es lo que habilita este disfraz. No es interpretación de texto sagrado, sino curvas empíricas con revisión por pares, lo que permite que relatos escatológicos idénticos a los de Kurzweil pasen de la periferia a Nature cuando los adoptan Hinton, Amodei o Bengio. La matemática no reemplaza al profeta, sino que lo complementa, dando legitimación científica a la movilización carismática.29 Sam Altman ha descrito las creencias sobre las leyes de escalamiento como sostenidas "a un nivel religioso"5, lo cual captura la paradoja de datos empíricos generando compromiso basado en fe.

Estructura, no creencia

Antes de seguir hay que cerrar una objeción que se instala de inmediato: "¿pero creen de verdad?".

La pregunta es razonable y equivocada a la vez, porque asume que la convicción antecede a la conducta.

Los estudios canónicos del milenarismo apuntan en sentido contrario y lo definen por rasgos estructurales, no psicológicos. Cohn fijó cinco criterios (salvación colectiva, terrenal, inminente, total, sobrenatural):81 si un relato los cumple es milenarista, con independencia de con cuánta sinceridad lo sostengan quienes lo repiten.

Y, sobre todo, lo definen por la inversión de la secuencia habitual entre creencia y práctica. Hobsbawm describió a los milenaristas medievales no como feligreses movidos por la fe, sino como gente con agravios materiales que disponía del lenguaje escatológico como única gramática para organizarse. Bourdieu lo generalizó con el término croyance pratique (creencia práctica): no hace falta creer explícitamente en las reglas del juego para jugarlo como si se creyese, basta haberse formado en el medio que las impone y la práctica se instala antes que la adhesión consciente.

Durkheim, desde el polo opuesto, mostró que el ritual colectivo produce la intensidad emocional que después se atribuye a lo trascendente: la liturgia antecede a la fe, no al revés. Los retiros de alineamiento y las reuniones internas sobre cronogramas de AGI son la forma contemporánea de esa dinámica: la intensidad que produce la práctica colectiva se lee después como evidencia de que el objeto se acerca.

Coexisten creyentes sinceros (Amodei, Sutskever) y adoptantes performativos (Altman, Zuckerberg), pero la distinción importa menos de lo que parece: el lenguaje existe antes que la adhesión individual, y la adhesión se forma habitándolo. El fenómeno vive en la puerta, no en quien la cruza.

Cinco rasgos

Con el mecanismo descrito, queda por fijar cómo se reconoce. Cinco rasgos en conjunto la separan de la gestión legítima de riesgos con la que se confunde a primera vista.

El primero es no declarar el salto entre regímenes epistémicos. Brian Wynne distinguió hace tres décadas entre riesgo (probabilidades y resultados conocidos), incertidumbre (resultados posibles sin probabilidades asignables) e ignorancia (no sabemos siquiera lo que no sabemos).62

Las leyes de escalamiento operan en el primer nivel. La extinción o la singularidad, en el tercero. El movimiento milenarista consiste en presentar ambos como si pertenecieran al mismo régimen, sin señalar la transición. La cuantificación ayuda a que el salto pase desapercibido: Theodore Porter describió la cuantificación como "una forma de tomar decisiones sin parecer decidir",25 y eso es lo que permite que una extrapolación de régimen 1 se presente como juicio neutral sobre escenarios de régimen 3.32

El segundo es discutir la magnitud del escenario catastrófico con más detalle que su probabilidad. Cass Sunstein lo llamó probability neglect: cuando las emociones están activadas, la atención se fija en la gravedad del resultado y desatiende cuán probable es.63 Las consecuencias se describen con precisión casi técnica, y las probabilidades quedan en la vaguedad del "no se puede descartar".

El tercero, invocar precaución sin satisfacer sus condiciones formales. Nassim Taleb y coautores exigen simultáneamente distribuciones de cola gruesa y riesgo sistémico para que el principio de precaución aplique en sentido estricto.75 Ninguna de las dos se ha demostrado para la IA en términos estadísticos. El marco precautorio se adopta como si sí.

El cuarto, y acaso el más revelador, absorber toda evidencia como confirmatoria sin actualizar a la baja. El muro de escalamiento de 2024 no rebajó las estimaciones de riesgo existencial. DeepSeek tampoco las moderó. La evidencia que debería desconfirmar se reinterpreta como que ahora "se escala otra cosa" o como que la amenaza se acerca más rápido aún.

El quinto, carecer de criterio consensuado para declarar que la emergencia ha pasado.76 Ningún actor en la IA de frontera ha propuesto qué condiciones permitirían rebajar la alarma.

Sin criterio de salida, el estado de excepción no tiene cómo terminar.

Bruce Rushing y Javier Gomez-Lavin han argumentado que la versión fuerte de la hipótesis de escalamiento (que nuevas capacidades "emergen" impredeciblemente con la escala) no es falsable en sentido popperiano: más compromiso metafísico que científico.37

Ningún rasgo por separado basta. Una preocupación legítima puede compartir uno o dos sin volverse milenarista. Es la conjunción de los cinco lo que identifica la variante. Una preocupación que declare su nivel epistémico, mantenga proporción entre evidencia y tono y especifique condiciones de salida no es milenarismo prudencial, por alarmante que sea su objeto.

El mapa

Cada rasgo del milenarismo clásico tiene un análogo directo en la comunidad de IA35:

| Rasgo milenarista | Análogo en la comunidad IA | Registro |

|---|---|---|

| Transformación inminente radical | AGI en X años; "singularidad" | Ambos |

| Figuras proféticas | Sutskever, Kurzweil, Yudkowsky, Altman | Clásico |

| Textos canónicos | Superintelligence, los papers de scaling, The Sequences | Ambos |

| Timeline calculable | Extrapolaciones de OOMs, leyes de escalamiento | Prudencial |

| Grupo elegido | Investigadores de alignment, comunidad racionalista | Ambos |

| Rituales | Cánticos de "Feel the AGI!", quema de efigie de IA no alineada, paranoia de laboratorio | Clásico |

| Urgencia moral | Dejarlo todo para trabajar en alignment; marco de "riesgo existencial" | Prudencial |

| Carrera armamentista / lucha cósmica | Carrera EE.UU.-China; humanidad vs. superinteligencia | Clásico |

| Cisma / herejía | El golpe del consejo de OpenAI; salida de Sutskever; doomer vs. aceleracionista | Clásico |

| Profecía autocumplida | Inversión justificada por la creencia produce las condiciones para más creencia | Prudencial |

| Coexistencia catastrofismo + progresismo | Doomers y utópicos dentro de las mismas organizaciones | Ambos |

La columna de registro es la distinción más útil del cuadro. Lo específico del milenarismo prudencial (curvas como autoridad, urgencia moral formulada como obligación preventiva, bucle inversión-validación) ocupa pocas filas. El resto es milenarismo tecnológico clásico: profetas, rituales, cismas, lenguaje de lucha cósmica.

La tesis de este ensayo es que los rasgos clásicos no habrían alcanzado el centro institucional que hoy ocupan sin el registro prudencial que los precede y los legitima. Lo prudencial es la puerta, y lo clásico, lo que entra por ella.

Dos registros

Visto así, las manifestaciones se ordenan en dos niveles que no hay que confundir.

La puerta

El primer registro es el prudencial: decisiones operativas y estructuras institucionales que serían incomprensibles sin la creencia de fondo, pero que hablan en el lenguaje anodino de cláusulas, contratos y memorandos.

La estructura legal de Anthropic incluye un fideicomiso (el Long-Term Benefit Trust) con autoridad para elegir y remover a la mayoría del consejo, cuyo propósito declarado es "the responsible development and maintenance of advanced AI for the long-term benefit of humanity".70 En el contrato entre Microsoft y OpenAI, la AGI tiene una definición financiera: si un sistema genera más de cien mil millones de dólares en beneficios, Microsoft pierde acceso a la tecnología.71 La escatología convertida en cláusula mercantil.

La carta fundacional de OpenAI declara como obligación fiduciaria principal no a los inversores ni a los empleados, sino a "humanity" en abstracto,65 formulación inconcebible en cualquier otro sector. Google DeepMind consolidó en 2024 sus equipos de seguridad en una organización de "AGI Safety & Alignment" que creció un 39% en un año.67 Las ofertas de empleo del Anthropic AI Safety Fellows Program reclutan "por reducir los riesgos catastróficos".66 Sequoia tituló su balance anual "Del Big Bang a la Sopa Primordial".68 Andreessen publicó un manifiesto de siete mil palabras argumentando que desarrollar IA es una "obligación moral" para la especie.69 Son textos de recursos humanos, memorandos de inversión, páginas corporativas. El propio campo de la "seguridad de la IA" ha multiplicado su plantilla en pocos años.72

Anthropic contrató en 2024 a un filósofo para investigar el "bienestar" de sus modelos de lenguaje y en 2025 anunció un programa formal de investigación al respecto.6 Esa decisión solo tiene sentido si se cree, al menos como posibilidad seria, que se está a punto de crear algo con experiencia subjetiva. Hallazgos recientes de interpretabilidad han empezado a dar materia prima a esa posibilidad, aunque nada de lo encontrado hasta ahora prueba consciencia.64 El mecanismo condicional-prudencial sigue operando (no hay demostración, hay posibilidad que no se puede descartar), pero la pregunta ha dejado de ser puramente especulativa.

Hay que trazar una frontera. Parte del trabajo de seguridad no necesita la creencia de fondo: evitar que un modelo alucine diagnósticos médicos, reducir sesgos en sistemas de selección de personal, impedir que un chatbot enseñe a fabricar armas. Son problemas de ingeniería sobre sistemas que ya existen, con daños concretos y verificables. Nada de eso requiere el "¿y si...?" existencial.

El milenarismo prudencial no describe toda preocupación por la seguridad de la IA, sino la que se organiza en torno a un evento futuro de magnitud irreversible cuya posibilidad no se puede descartar.

La escatología habla ya en el lenguaje más anodino que existe, y eso es lo que la hace invisible.

Lo que entró

El segundo registro es milenarismo tecnológico clásico en estado puro. No habría llegado tan lejos por sí solo: sin el envoltorio prudencial que lo escolta, habría seguido siendo Kurzweil en una sala de conferencias de 2005. Con él, ocupa despachos corporativos.

La cultura interna de los laboratorios lo exhibe sin disfraz: los cánticos de "Feel the AGI!" liderados por Ilya Sutskever en OpenAI, la autocensura de GPT-2, la quema de una efigie de IA no alineada,13 la petición de salas de servidores a prueba de ametralladoras. Un sistema de creencias organizado en torno a un vuelco inminente cuyas señales pueden leerse en las curvas de cómputo, y cuya llegada exige preparación moral, institucional y técnica.

Los gestos individuales completan el cuadro. Geoffrey Hinton abandonó Google para advertir sobre riesgo existencial. Yoshua Bengio pasó de investigación pura a gobernanza de seguridad. Leopold Aschenbrenner escribió un tratado escatológico prediciendo la AGI para 2027 en términos de emergencia de seguridad nacional y luego fundó una firma de inversión.14 Anthony Levandowski fundó literalmente una iglesia para adorar a la IA.15 Los Zizians, un grupo escindido del racionalismo y la seguridad de IA, se han vinculado a seis muertes violentas entre 2022 y 202516 (el caso más extremo de este ecosistema).

La relación entre los dos registros es la clave del fenómeno. El clásico proporciona el contenido; el prudencial, la autorización para decirlo sin parecer excéntrico.

Un CEO que explicara sus decisiones apelando a "Feel the AGI" sería cesado. El mismo CEO apelando a "responsabilidad fiduciaria con la humanidad" es respetable.

Y una vez dentro del perímetro institucional, el contenido clásico no necesita el disfraz en todos los momentos: puede emerger en retiros, en entrevistas informales, en rituales privados, sabiendo que el envoltorio prudencial está listo para recubrirlo cuando haga falta.

La simetría catástrofe-salvación

Los dos polos del milenarismo prudencial (el catastrofista y el beatífico) no son posiciones independientes: se implican mutuamente.30 Quien afirma que la IA puede destruirnos le atribuye un poder absoluto sobre el curso de la historia, y si tiene ese poder también puede salvarnos. La afirmación funciona en las dos direcciones.

Por eso Dario Amodei escribe simultáneamente sobre riesgo existencial y sobre abundancia post-escasez,17 y por eso la posición intermedia (la IA como herramienta progresivamente útil, relevante y de impacto, pero sin vuelco existencial) resulta inaudible. No es que no exista ni que no haya gente que la sostenga, sino que carece de estructura institucional y de retórica, porque no moviliza nada. No se escriben manifiestos sobre "la IA mejorará gradualmente".

Nadie funda laboratorios para eso.

El terreno que lo hizo posible

El milenarismo prudencial tiene además un terreno cultural preparado.31 La cultura popular lleva décadas ofreciendo un binarismo sobre la inteligencia artificial: HAL 9000 o R2-D2, Skynet o JARVIS, Terminator o Her.

Juguete de madera o niño de verdad, sin estados intermedios.

Como género literario, la ciencia ficción es amplia y tiene algunas obras que se acercan a la realidad de la IA actual (se me ocurre, por ejemplo, el relato "El ciclo de vida de los objetos de software" de Ted Chiang). Pero la ciencia ficción popular, y particularmente la audiovisual, no nos dio vocabulario para lo que realmente tenemos: sistemas que son algo más que loros estocásticos pero menos que entes conscientes, que aciertan a menudo y alucinan con la misma confianza, que impresionan y decepcionan en la misma conversación.

Décadas de computación determinista refuerzan esa carencia: la calculadora no se equivoca, la hoja de cálculo no improvisa... la expectativa por defecto ante una máquina que habla con fluidez es que lo que dice sea verdad. Cada fallo de un modelo de lenguaje no se interpreta como propiedad inherente de un sistema probabilístico, sino como defecto temporal que la próxima versión corregirá, lo cual alimenta la expectativa de una versión perfecta por llegar.

Este sustrato no es en sí mismo el milenarismo prudencial, pero sí es el terreno que lo hace posible. Proporciona las únicas casillas disponibles (amenaza existencial o salvación) y convierte cada mejora incremental en paso hacia un ideal.

La escalada

El arco del fenómeno se puede recorrer en tres momentos, y lo instructivo es que el tono no varía entre ellos aunque la base empírica sí.

En 2014 y 2015 el tono escatológico ya está completo sin que nada cuantitativo lo respalde. Bostrom publica Superintelligence; Musk compara la IA con las armas nucleares y con invocar al demonio; Hawking, Hassabis, Russell, Norvig y centenares de investigadores firman la carta del Future of Life Institute sobre riesgo existencial; se funda OpenAI como organización sin ánimo de lucro porque sus fundadores creen que la gobernanza de la AGI ya importa; Altman escribe que "el desarrollo de inteligencia de máquina sobrehumana es probablemente la mayor amenaza a la existencia continuada de la humanidad".7

En ese momento las leyes de escalamiento aún no existen, los modelos de lenguaje son irrelevantes y el deep learning solo ha producido hitos en tareas acotadas. Pero la estructura escatológica está ya instalada: profetas, cartas canónicas, urgencia moral. Hinton, Musk y Bostrom usaban el mismo tono y la misma urgencia que usarán una década después, cuando sí ha habido (algunos) avances en esa dirección.

La intensidad no se calibró con los datos: vino preinstalada.

En 2020 las curvas dan legitimación a lo que hasta entonces era palabra de Kurzweil. Jared Kaplan y coautores formalizan las leyes de escalamiento como relaciones de potencia con exponentes medibles, y GPT-3 valida empíricamente las extrapolaciones.2

La mediana de expertos en 2015 situaba la AGI en 2060. En 2020, la mitad del laboratorio de OpenAI la estimaba para 15 años.12 Lo que cambió no es la creencia, que ya estaba, sino su respetabilidad: los mismos relatos escatológicos de la periferia ocupan ahora Nature y los despachos corporativos.

El envoltorio prudencial ya está en su sitio.

El tercer momento es la prueba. Si el milenarismo prudencial fuese lectura fiel de las curvas, debería debilitarse cuando las curvas se tuercen.

En la segunda mitad de 2024 los retornos del escalamiento se estancan: los benchmarks se saturan pese a aumentos masivos en el presupuesto de entrenamiento.51 Sutskever, uno de los fundadores de la cultura del escalamiento, reconoce en NeurIPS que "la década de 2010 fue la era del escalamiento. Ahora hemos vuelto a la era del asombro y el descubrimiento".52

DeepSeek, en enero de 2025, iguala los resultados de frontera con una fracción del coste y GPUs de generación anterior. Nvidia pierde 589.000 millones de capitalización en un solo día.54

Si la ecuación profética era "más cómputo = más capacidad = más urgencia", DeepSeek la cuestiona de frente. La narrativa no se rompe: se redirige. OpenAI lanza o1, que escala cómputo en inferencia en vez de entrenamiento, y la comunidad absorbe el giro sin dificultad. Altman: "no hay muro".53

El "¿y si...?" se reformula: "¿y si China llega primero?"

A principios de 2026 el milenarismo prudencial se ha partido en dos, y la forma en que se parte es lo que más dice sobre él.

La facción comercial abandona la retórica de seguridad cuando deja de ser rentable: OpenAI elimina "safely" de su misión,55 Trump revoca la orden ejecutiva de Biden,56 París rebautiza la cumbre de seguridad como cumbre de acción.57

La facción milenarista se concentra en circuitos más estrechos y mejor financiados: Sutskever funda Safe Superintelligence Inc. y levanta 3.000 millones sin producto ni ingresos; en marzo de 2026 la empresa se valora en 32.000 millones.58 Aschenbrenner convierte la profecía directamente en vehículo de inversión: un hedge fund que gestiona 5.500 millones en renta variable, apostando a empresas eléctricas y mineros de Bitcoin como infraestructura para la superinteligencia.59

La bifurcación no es una complicación del marco, es su confirmación empírica. Cuando el envoltorio prudencial deja de ser rentable, quienes lo llevaban instrumentalmente lo sueltan; quienes lo sostenían por convicción se quedan con él y, al hacerlo, quedan al descubierto como lo que son.

Lo que hasta 2024 parecía consenso del sector era la suma de dos cosas distintas que compartían lenguaje: una facción que operaba realmente sobre premisas escatológicas y otra que se beneficiaba de hablar así. En el momento en que la retórica se vuelve pasivo comercial, se separan.

La profecía, entretanto, financia su propia validación: si inviertes miles de millones en infraestructura para la AGI, la AGI se vuelve más probable, lo que valida la inversión. El circuito se cierra.

El arco muestra tres fases del mecanismo: construcción de la creencia sin base empírica, institucionalización cuando las curvas la legitiman, y bifurcación cuando la realidad deja de cooperar. Lo que no muestra es una fase de abandono.

Genealogía: por qué este caso es distinto

El mecanismo (extrapolación matemática como motor profético) tiene precedentes, pero ninguno compartió lo que hace singular al caso actual.

Newton aplicó cálculo aritmético a la profecía bíblica de Daniel y concluyó que el fin llegaría en 2060.18 Malthus, en 1798, convirtió el crecimiento geométrico frente al aritmético en catástrofe calculable, con raíces teológicas providencialistas que la forma matemática sobrevivió.19 En 1960, Heinz von Foerster publicó en Science una "ecuación del Juicio Final" que extrapolaba el crecimiento poblacional a una singularidad matemática el 13 de noviembre de 2026.20 Paul Ehrlich predijo en 1968 hambrunas masivas para los setenta y ochenta, con una autoridad que el fracaso no disipó del todo.21 El Club de Roma, en 1972, usó el primer modelo computacional global para predecir colapso de recursos.22

Lo que comparten es la forma: ajuste de curvas empírico extrapolado a un horizonte catastrófico. Lo que no comparten es el mecanismo condicional-prudencial. Newton creía su predicción. Malthus creía la suya. Ehrlich creía la suya.

El precedente estructural más directo, el pico del petróleo o Peak Oil, también operó como predicción directa: la curva logística de M. King Hubbert afirmaba que la producción petrolera de EE.UU. tocaría techo a principios de los setenta, y cuando lo hizo en 1970 se generó un movimiento escatológico completo. En un seguimiento de 2013, solo el 10% de los creyentes había cuestionado significativamente su convicción, pese a que el plazo había fallado y la producción estadounidense superó el pico original en 2018.23

La base matemática hizo la creencia más resistente, no menos.

Pero en todos los casos la autorización y el compromiso coincidían. El profeta afirmaba X y cargaba con X. La estructura moderna de la IA rompe por primera vez esa identidad: el milenarismo prudencial permite enunciar X sin cargar con X, porque lo que se afirma no es "X ocurrirá" sino "X no puede descartarse". El profeta ya no necesita creer, ni convencer de su creencia, basta con que el oyente no pueda negar la posibilidad. Y esa disociación entre autorización y compromiso es el rasgo que ningún precedente tiene. De ahí la resistencia del marco.

La genealogía apunta también en la otra dirección. El caso más nítido de extrapolación matemática que acertó es el agujero de la capa de ozono: en 1974 Molina y Rowland predijeron, a partir de la fotoquímica de los CFCs, que acabarían destruyendo el ozono estratosférico; en 1985 Farman detectó el adelgazamiento sobre la Antártida; en 1987 el Protocolo de Montreal retiró los compuestos y la capa ha empezado a recuperarse en los plazos proyectados.77

La pregunta interesante es qué separa la alarma legítima de la profecía, y hay al menos tres cosas que el ozono tenía y la IA no: un mecanismo causal cerrado que conecta la variable medida con el resultado predicho (la fotólisis de los CFCs libera cloro atómico que cataliza la destrucción del O₃), predicciones falsables (adelgazamiento medible, con magnitud y localización estimadas de antemano) e independencia entre la predicción y el objeto predicho (los CFCs seguían destruyendo ozono al margen de lo que los químicos publicaran sobre ello).

En la IA falta todo eso: el mecanismo entre "los modelos mejoran" y "esto puede extinguirnos" es el salto no articulado que este ensayo describe, la AGI carece de definición que permita falsación limpia, y la creencia en el escalamiento causa la inversión que produce el cómputo que parece validarla. No toda extrapolación matemática produce profecía (a veces produce alarma legítima), pero la IA se parece más a Peak Oil que al ozono, y por las mismas razones, con un ingrediente añadido que ni Peak Oil tenía: la disociación autorización/compromiso.

La Ley de Moore funciona como precedente inmediato y ambiguo. Se trató durante décadas como algo a medio camino entre predicción y profecía-como-mecanismo-de-coordinación, un objetivo autorreforzante donde la industria de semiconductores se organizaba para cumplirlo.24

Es el antecedente más cercano al bucle inversión-validación actual, pero sin la carga escatológica: Moore no prometía salvación ni extinción, solo más transistores.

Por qué resiste y cómo se falsifica

Definido el criterio, queda la pregunta por la durabilidad. Los milenarismos tradicionales suelen desinflarse cuando la fecha pasa; este, no.

La primera razón está en la forma de la evidencia. Cada nueva generación de modelos es mejor que la anterior, y eso basta para mantener la expectativa de que el siguiente paso será el decisivo. Nunca hay un momento de desconfirmación limpia porque la curva no se rompe, solo "aún no ha llegado".

Desde que ChatGPT puso los modelos de lenguaje en manos de todo el mundo, no ha ocurrido nada existencial, pero la expectativa no ha cedido un milímetro.

El cumplimiento parcial seduce de un modo particular: a diferencia de Malthus, Ehrlich o Peak Oil, las predicciones de escalamiento se han validado en cada paso (GPT-2 a GPT-3 a GPT-4), y esa cadena de aciertos vuelve racional la extrapolación al siguiente paso, aunque el salto a la AGI sea estructuralmente idéntico a las extrapolaciones escatológicas previas que fallaron.

La AGI, al carecer de definición consensuada, no puede producir un fallo limpio: a diferencia de Peak Oil, cuya fecha podía pasar sin cumplirse, aquí el umbral se desplaza: siempre puede no haber llegado aún, o haber llegado ya, según cómo se trace. Y cuando algo se tuerce, las ecuaciones ofrecen un suministro inagotable de hipótesis auxiliares que preservan la predicción central: si la AGI no llega para 2027, la respuesta no es "la matemática estaba equivocada" sino "subestimamos el cómputo necesario" o "necesitamos un nuevo paradigma de escalamiento".33

La segunda razón es económica. Amazon, Google, Meta y Microsoft gastan en conjunto unos 400.000 millones de dólares anuales en infraestructura de IA, justificados en gran medida por la extrapolación de leyes de escalamiento. Altman ha estimado que se necesitan siete billones para expansión de semiconductores.27 Un profeta tradicional no puede movilizar esas cifras. Una gráfica de ley de potencias sí.34

Esas gráficas son además un dispositivo retórico engañoso: Toby Ord ha mostrado que la escala logarítmica con que habitualmente se presentan los resultados enmascara rendimientos decrecientes extremos, hasta el punto de que reducir a la mitad el error restante requiere un millón de veces más cómputo.26 Una ilusión óptica con consecuencias de miles de millones de dólares.

Y una vez movilizados esos millones, la creencia en el escalamiento causa directamente la inversión que produce el cómputo que pone a prueba la hipótesis de escalamiento. Malthus, Ehrlich y el Peak Oil no tenían este bucle autorreferencial. Es profecía autocumplida por diseño: la predicción moldea el objeto mismo de la predicción, no solo el mercado a su alrededor.36

La tercera razón es estructural. Para operar en la IA de frontera (atraer inversión y talento) hay que hablar en términos de transformación de época. Altman promete "inteligencia demasiado barata para medir el coste",73 eco exacto de la promesa nuclear de 1954, que fue milenarismo tecnológico puro y resultó ser falsa. Amodei predice la curación del 95% de los cánceres en un "siglo XXI comprimido".17 Hassabis quiere "resolver la inteligencia y luego usarla para resolver todo lo demás".

Ninguna empresa de otro sector describe su producto en términos de salvación o extinción de la especie. En IA es el registro por defecto. El relato se reproduce porque el sector lo exige, y en algún momento dejó de ser una creencia para convertirse en condición de entrada.38 Will Douglas Heaven, en MIT Technology Review, lo llamó "the most consequential conspiracy theory of our time".74

El contraargumento que hay que tomarse en serio

El contraargumento más fuerte al milenarismo prudencial es obvio: ¿y si las predicciones se cumplen? AlphaGo, GPT-3, GPT-4, AlphaFold... todas validaron predicciones específicas de escalamiento. El argumento del "núcleo racional" dice que quizá no es milenarismo, sino una respuesta racional a evidencia real.39

Es un contrapunto válido, y hay que concederle más de lo que suele concedérsele. Parte del lenguaje que en 2014 sonaba desproporcionado tiene hoy una base empírica que no tenía: el scheming, la resistencia al apagado, la deshonestidad estratégica documentada en los laboratorios desde 2024 han acortado el salto entre la evidencia y la preocupación. El argumento del núcleo racional no es una coartada retórica, describe algo real, pasos en el camino aunque aún lejos de trazar el camino completo.

Pero eso es precisamente lo que delata la estructura. Una comunidad que ajusta su preocupación a la evidencia se habría preocupado menos en 2014 y más en 2025. Lo que se observa es lo contrario: la misma intensidad en ambos momentos. Que la evidencia posterior haya acortado (un poco y en algunos casos) la distancia no valida retroactivamente una alarma que nunca dependió de ella. El milenarismo no está en los datos ni en la extrapolación local (el próximo modelo será mejor, y probablemente lo será), sino en el salto no articulado entre "los modelos mejoran predeciblemente" y "esto puede extinguirnos o salvarnos".

Ese salto sigue sin cerrarse, aunque sea un poco más corto que antes.

Hay una forma concreta de ver la diferencia. La actualización bayesiana es simétrica: la evidencia que confirma sube la probabilidad y la que desconfirma la baja. En el milenarismo prudencial toda evidencia confirma y ninguna desconfirma. Cuando el razonamiento se refugia en el condicional prudencial, ya no estamos ante Bayes sino ante una variante de la apuesta de Pascal, con el mismo defecto que el propio Bostrom identificó: cualquier consecuencia suficientemente grande domina cualquier probabilidad suficientemente pequeña.82 Una comunidad que actualiza bayesianamente puede especificar de antemano qué evidencia rebajaría su probabilidad.

Hasta ahora nadie en la IA de frontera ha propuesto un criterio consensuado para declarar que la emergencia ha pasado, y esa ausencia no es un descuido: es un rasgo estructural del marco.

Hay además un dato incómodo para el argumento del núcleo racional. Investigadores como Rylan Schaeffer y otros han mostrado que los "saltos" de capacidad aparente en los modelos grandes pueden ser artefactos de la métrica elegida: más del 92% de las capacidades emergentes aparecen bajo una de dos métricas específicas, y métricas más suaves no muestran cambios súbitos.28 Si parte de la evidencia que alimenta la urgencia es un artefacto estadístico, el "¿y si...?" prudencial pierde parte de su base.

¿Cómo se falsifica el diagnóstico mismo?

Queda una pregunta que el propio marco debe responder. Si el milenarismo prudencial describe una estructura resistente a la desconfirmación, ¿no es el diagnóstico mismo resistente a la desconfirmación?

No necesariamente. Dejaría de ser útil si el tono escatológico se ajustase a la evidencia (se moderase cuando las curvas se aplanan, se intensificase solo cuando alguien trace el camino concreto entre "los modelos mejoran" y "esto puede extinguirnos"). Dejaría de serlo si la comunidad tuviese un criterio consensuado para declarar que la emergencia ha pasado. O si la infraestructura institucional pudiese desmontarse con la misma facilidad con que se construyó cuando la evidencia cambie de signo.

Hasta ahora no se ha dado ninguna de las tres.

El muro de escalamiento de 2024 no moderó la retórica: la redirigió. No existe criterio de salida. Y la infraestructura solo crece.

El milenarismo prudencial no es una acusación de irracionalidad. Es la observación de que una estructura de pensamiento escatológica (con sus profetas, sus textos canónicos, sus elegidos, su urgencia moral y su resistencia a la desconfirmación) se instaló en el centro de una de las industrias más poderosas del mundo, y lo hizo por la puerta de atrás: no como fe declarada, sino como prudencia.

El concepto tampoco pretende falsar las predicciones. Puede que los modelos sigan mejorando y que algunos temores se confirmen; el núcleo racional existe. Pero ese no es el plano en el que se juega el diagnóstico. Desde fuera, el milenarismo prudencial es indistinguible de una gestión seria de riesgos: ambos invocan curvas empíricas, razonan en condicional y movilizan infraestructura en nombre del "¿y si...?". No hay criterio observacional que los separe.

Esa indistinguibilidad no es un defecto del análisis ni una finura que se le escape al concepto. Es el fenómeno mismo. El milenarismo prudencial funciona porque no puede reconocerse como milenarismo: si se presentara como fe, la crítica habitual lo desactivaría. Entra por la prudencia, y solo mientras siga pareciéndose a ella puede entrar. La indistinguibilidad es su condición de posibilidad, no un límite del observador.

Notas

Nick Bostrom, Superintelligence: Paths, Dangers, Strategies (Oxford University Press, 2014). La declaración de Musk sobre la IA como "potencialmente más peligrosa que las armas nucleares" es un tuit del 3 de agosto de 2014; la comparación con "invocar al demonio", del MIT AeroAstro Centennial Symposium, 24 de octubre de 2014. La carta abierta del Future of Life Institute, "Research Priorities for Robust and Beneficial Artificial Intelligence" (enero 2015), fue firmada por Hawking, Musk, Hassabis, Russell, Norvig y centenares de investigadores.

Dario Amodei y Danny Hernandez, "AI and Compute", blog de OpenAI (mayo 2018), documenta que el cómputo de los mayores entrenamientos se duplicaba cada 3,4 meses. Jared Kaplan et al., "Scaling Laws for Neural Language Models", arXiv:2001.08361 (enero 2020), formalizó la relación como leyes de potencia con exponentes medibles.

El concepto se inscribe en una línea de investigación activa sobre escatología tecnológica: John M. Bozeman, "Technological Millenarianism in the United States", en Millennium, Messiahs, and Mayhem (Routledge, 1997); Robert M. Geraci, Apocalyptic AI: Religion and the Promise of Artificial Intelligence (Oxford University Press, 2010); Susannah Crockford, "Artificial Intelligence and Technological Millenarianism", en Critical Dictionary of Apocalyptic and Millenarian Movements (Cambridge, 2021). La contribución propia es el mecanismo condicional-prudencial que distingue esta instancia.

Ray Kurzweil, The Singularity Is Near: When Humans Transcend Biology (Viking, 2005).

Sam Altman, entrevista con Garry Tan, How to Build the Future, Y Combinator, 8 de noviembre de 2024 (vídeo: https://www.youtube.com/watch?v=xXCBz_8hM9w). La frase exacta, transcrita por Gary Marcus ("The new AI scaling law shell game", Substack, noviembre 2024) y citada por Donald MacKenzie ("AI's Scale", London Review of Books 48(2), enero 2026): "A religious level belief [...] was [...] that that wasn't going to stop."

Anthropic, "Exploring model welfare", blog de Anthropic, 24 de abril de 2025 (https://www.anthropic.com/research/exploring-model-welfare). Kyle Fish, filósofo y coautor de "Taking AI Welfare Seriously" junto a David Chalmers, fue contratado en septiembre de 2024 como primer investigador dedicado al bienestar de modelos en una gran empresa de IA.

Sam Altman, "Machine Intelligence, Part 1", blog personal (enero 2015).

Katja Grace et al., "When Will AI Exceed Human Performance? Evidence from AI Experts", Journal of Artificial Intelligence Research 62 (2018), recoge la mediana de 2060 en la encuesta de 2015. Las estimaciones internas de OpenAI circa 2020 provienen de Karen Hao, "The messy, secretive reality behind OpenAI's bid to save the world", MIT Technology Review, 17 de febrero de 2020: "Every year, OpenAI's employees vote on when they believe artificial general intelligence, or AGI, will finally arrive. [...] Half the lab bets it is likely to happen within 15 years."

Karen Hao y Charlie Warzel, "Inside the Chaos at OpenAI", The Atlantic, 19 de noviembre de 2023. Tres empleados describieron los rituales de Sutskever: "His constant, enthusiastic refrain was 'feel the AGI' [...] Sutskever commissioned a wooden effigy from a local artist that was intended to represent an 'unaligned' AI [...] He set it on fire to symbolize OpenAI's commitment to its founding principles." Resumido en Victor Tangermann, "OpenAI Employees Say Firm's Chief Scientist Has Been Making Strange Spiritual Claims", Futurism, 20 de noviembre de 2023.

Leopold Aschenbrenner, "Situational Awareness: The Decade Ahead" (junio 2024). Predice AGI para 2027 y superinteligencia poco después, en un marco de emergencia de seguridad nacional. Aschenbrenner fundó posteriormente la firma de inversión Situational Awareness LP.

Anthony Levandowski registró Way of the Future en 2017 como organización religiosa dedicada a "desarrollar y promover la realización de una deidad basada en inteligencia artificial". Se disolvió en 2021.

La comunidad Ziziana, grupo escindido del racionalismo y la seguridad de IA en la bahía de San Francisco, ha sido vinculada a seis muertes violentas entre finales de 2022 y enero de 2025. Véase EJ Dickson, "6 Deaths, 3 States and the Radical Breakaway 'Rationalists' at the Center of the Nightmare", Rolling Stone, 26 de febrero de 2025; "Inside the Zizians, a radical California-based vegan cult now linked to 6 violent deaths", The Boston Globe, 11 de febrero de 2025; y la cronología de PBS News, "A timeline of cultlike 'Zizian' group tied to killing of a Border Patrol agent in Vermont" (2025). La líder del grupo, Jack "Ziz" LaSota, fue arrestada en febrero de 2025.

Dario Amodei, "Machines of Loving Grace: How AI Could Transform the World for the Better", blog de Anthropic (octubre 2024). Véase también su testimonio ante el Comité de Asuntos Judiciales del Senado de EE.UU. sobre riesgos existenciales de la IA (julio 2023).

Stephen D. Snobelen, "A Time and Times and the Dividing of Time: Isaac Newton, the Apocalypse, and 2060 A.D.", Canadian Journal of History 38 (2003). Newton calculó la fecha aplicando aritmética a la profecía de Daniel: si el período de 1.260 "día-años" comenzó alrededor del 800 d.C., el fin llegaría en 2060.

Thomas Robert Malthus, An Essay on the Principle of Population (1798). Sobre las raíces teológicas inseparables de su teoría: J. M. Pullen, "Malthus' Theological Ideas and Their Influence on His Principle of Population", History of Political Economy 13(1), 1981.

Heinz von Foerster, Patricia M. Mora y Lawrence W. Amiot, "Doomsday: Friday, 13 November, A.D. 2026", Science 132(3436), noviembre 1960.

Paul R. Ehrlich, The Population Bomb (Sierra Club/Ballantine, 1968). Sobre cómo la forma matemática dio autoridad al concepto: Carole McCann, Figuring the Population Bomb: Gender and Demography in the Mid-Twentieth Century (University of Washington Press, 2016).

Donella H. Meadows et al., The Limits to Growth (Universe Books, 1972), encargado por el Club de Roma. El modelo World3 fue desarrollado en el MIT.

Matthew Schneider-Mayerson, Peak Oil: Apocalyptic Environmentalism and Libertarian Political Culture (University of Chicago Press, 2015). El dato del 10% proviene de una encuesta de seguimiento incluida en el libro.

Paul E. Ceruzzi, "Moore's Law and Technological Determinism: Reflections on the History of Technology", Technology and Culture 46(3), julio 2005.

Theodore M. Porter, Trust in Numbers: The Pursuit of Objectivity in Science and Public Life (Princeton University Press, 1995).

Toby Ord, "The Scaling Paradox", ensayo publicado en tobyord.com y forethought.org, 13 de enero de 2025 (https://www.tobyord.com/writing/the-scaling-paradox). Forma parte de una serie más amplia sobre escalamiento en IA. Ord muestra que el paper fundacional de OpenAI (Kaplan et al., 2020) implica que el cómputo necesario crece como la potencia vigésima de la precisión deseada, y que las gráficas en escala logarítmica enmascaran rendimientos decrecientes extremos.

Las cifras de inversión colectiva provienen de los informes financieros trimestrales de Amazon, Alphabet, Meta y Microsoft del período 2024-2025. La estimación de siete billones para expansión de semiconductores fue atribuida a Altman por The Wall Street Journal (febrero 2024).

Rylan Schaeffer, Brando Miranda y Sanmi Koyejo, "Are Emergent Abilities of Large Language Models a Mirage?", Advances in Neural Information Processing Systems (NeurIPS), 2023.

Elke Schwarz, "Conjuring the End: Techno-eschatology and the Power of Prophecy", Opinio Juris (enero 2025). Argumenta que las predicciones de AGI funcionan como profecía autocumplida: las previsiones repetidas se convierten en "hechos" y luego en "sagradas", colapsando la distinción entre previsión y fabricación de destino. La creencia sirve directamente a intereses financieros mediante lo que Dave Elder-Vass llama "producción simbólica".

Catherine Wessinger distingue milenarismo catastrofista (el mal es tan grande que solo la destrucción total y renovación pueden salvarnos) del milenarismo progresivo (los humanos trabajan activamente hacia la salvación con guía sobrehumana). La coexistencia de ambos polos dentro de la misma comunidad de IA — doomers y utópicos, a menudo en las mismas organizaciones — replica el patrón que Wessinger identifica en movimientos milenaristas históricos. Véase The Oxford Handbook of Millennialism (Oxford University Press, 2000).

David Noble, The Religion of Technology: The Divinity of Man and the Spirit of Invention (Knopf, 1997), traza cómo la tecnología occidental ha estado entrelazada con el milenarismo cristiano desde el siglo IX: la convicción de que el conocimiento técnico ayuda a recuperar lo perdido en el Edén. Erik Davis, TechGnosis: Myth, Magic, and Mysticism in the Age of Information (Harmony Books, 1998; ed. actualizada, North Atlantic Books, 2015), revela el fervor místico y milenarista que acompaña cada nueva tecnología de comunicación, desde la imprenta a Internet. Juntos establecen que el sustrato cultural que habilita el milenarismo prudencial no es accidental sino estructural.

Wendy Espeland y Mitchell Stevens, "Commensuration as a Social Process", Annual Review of Sociology 24 (1998). Argumentan que la conmensuración — reducir diferentes cualidades a una métrica común — "no es un mero proceso técnico sino un rasgo fundamental de la vida social" que funciona como "un modo de poder". Aplicado a las leyes de escalamiento: el acto de trazar curvas de pérdida en ejes log-log es en sí mismo una operación de poder que hace que ciertos futuros parezcan calculables y otros inimaginables.

Leon Festinger, Henry Riecken y Stanley Schachter, When Prophecy Fails (University of Minnesota Press, 1956), mostró que los creyentes a menudo refuerzan su fe tras la desconfirmación. Thomas Kelly, "Debunking 'When Prophecy Fails'", Journal of the History of the Behavioral Sciences (2025), cuestiona la validez del estudio original. Sin embargo, el mecanismo aplica: el milenarismo matemático maneja la desconfirmación de un modo distintivo porque la forma matemática proporciona escotillas de escape integradas — cambiar el timeline, invocar un nuevo paradigma, redefinir el objetivo. Los datos de Schneider-Mayerson sobre Peak Oil (90% de creyentes mantuvieron su convicción tras el fallo del plazo) lo respaldan empíricamente.

Aldo Mascareño, "Contemporary Visions of the Next Apocalypse: Climate Change and Artificial Intelligence", European Journal of Social Theory 27(2): 352-371, 2024. Argumenta que las visiones apocalípticas "ofrecen un guión que puede aplicarse en diversas situaciones históricas para lidiar con la incertidumbre del presente, justificar la acción política y asignar recursos". La movilización de capital sin precedentes en IA — un profeta tradicional no puede movilizar cientos de miles de millones en inversión corporativa anual, pero una gráfica de ley de potencias sí — es la manifestación más extrema de este mecanismo.

Norman Cohn, The Pursuit of the Millennium (Secker & Warburg, 1957; ed. revisada, Oxford University Press, 1970). Richard Landes, Heaven on Earth: The Varieties of the Millennial Experience (Oxford University Press, 2011). Landes distingue entre "roosters" (figuras proféticas que anuncian el fin inminente) y "owls" (voces prudentes anti-apocalípticas), un marco directamente aplicable: Sutskever, Aschenbrenner y Altman como roosters; Gary Marcus, François Chollet y Melanie Mitchell como owls.

Robert K. Merton, "The Self-Fulfilling Prophecy", Antioch Review 8(2): 193-210 (1948). Sobre la performatividad de las expectativas tecnológicas: Mads Borup, Nik Brown et al., "The Sociology of Expectations in Science and Technology", Technology Analysis & Strategic Management 18(3-4): 285-298, 2006; Sheila Jasanoff, Dreamscapes of Modernity: Sociotechnical Imaginaries and the Fabrication of Power (University of Chicago Press, 2015). Lo peculiar del caso es que el bucle no moldea solo el mercado, sino el objeto mismo de la predicción: la capacidad de los modelos es función directa de la inversión que la creencia en el escalamiento genera.

Bruce Rushing y Javier Gomez-Lavin (Purdue), "Is the Scaling Hypothesis Falsifiable?", presentado en la 29th Biennial Meeting de la Philosophy of Science Association (PSA), Nueva Orleans, noviembre 2024; disponible en PhilSci-Archive, ID 23622. Argumentan que la versión fuerte de la hipótesis de escalamiento — que nuevas capacidades cognitivas "emergen" de forma impredecible con la escala — no es falsificable en sentido popperiano: más compromiso metafísico que científico.

Timnit Gebru y Émile P. Torres, "The TESCREAL bundle: Eugenics and the promise of utopia through artificial general intelligence", First Monday 29(4), abril 2024. El acrónimo cubre Transhumanismo, Extropianismo, Singularitarismo, Cosmismo, Racionalistas, Altruismo Efectivo y Longtermismo. Lo tratan explícitamente como religión secular con paralelos a la escatología cristiana, lo que refuerza la observación de que el milenarismo prudencial no es una creencia individual sino una infraestructura ideológica que funciona como condición de entrada al sector.

David Thorstad, "Against the Singularity Hypothesis", Philosophical Studies 182(7): 1627-1651, 2025. Argumenta que la hipótesis de la singularidad descansa en "supuestos de crecimiento insuficientemente respaldados" y ofrece cinco razones para el escepticismo. No usa el marco milenarista, pero su análisis filosófico apunta al mismo problema: el salto entre la evidencia de mejora continua y la conclusión de transformación existencial no está justificado por los datos.

Robert M. Geraci, "Apocalyptic AI: Religion and the Promise of Artificial Intelligence", Journal of the American Academy of Religion 76(1): 138-166 (2008); desarrollado en Apocalyptic AI: Visions of Heaven in Robotics, Artificial Intelligence, and Virtual Reality (Oxford University Press, 2010). Geraci muestra que las promesas de la IA (inmortalidad digital, trascendencia, creación de seres superiores) replican la estructura de la escatología judeocristiana. Sus figuras de referencia — Moravec, Kurzweil, Warwick — son anteriores al giro post-2014.

Susannah Crockford, "Artificial Intelligence and Technological Millenarianism", en Critical Dictionary of Apocalyptic and Millenarian Movements, CenSAMM, Universidad de Cambridge, 2021. Clasifica el discurso de la IA como variante secular del milenarismo tecnológico, con muchos de los patrones que trato aquí, pero escribe justo antes de la revolución de los modelos de lenguaje.

Gebru y Torres, "The TESCREAL bundle" (véase nota 38). Trazan la genealogía ideológica desde el transhumanismo hasta la carrera actual por la AGI y señalan la dimensión escatológica, pero atribuyen su influencia a la financiación y el poder institucional, no al mecanismo epistémico.

Varios reportajes documentaron el estancamiento durante la segunda mitad de 2024: "AI scaling laws are showing diminishing returns, forcing AI labs to change course", TechCrunch, 20 de noviembre de 2024; reportes similares en The Information y Bloomberg.

Ilya Sutskever, charla en NeurIPS, diciembre de 2024. También declaró: "Pre-training as we know it will end" porque "we have but one internet" y que "scaling the right thing matters more now than ever."

Sam Altman, declaraciones públicas durante la segunda mitad de 2024. OpenAI lanzó o1 (nombre en clave "Strawberry") en septiembre de 2024, un modelo que escala cómputo en tiempo de inferencia. El rendimiento en el examen AIME 2024 pasó del 74% (muestra única) al 93% con muestreo extenso.

DeepSeek lanzó R1 el 20 de enero de 2025. La empresa afirmó haber entrenado su modelo V3 por 6 millones de dólares, frente a los más de 100 millones estimados para GPT-4, usando GPUs de generación anterior (A100) accesibles pese a las restricciones de exportación de EE.UU. a China. Nvidia perdió aproximadamente 589.000 millones de dólares de capitalización el 27 de enero de 2025, la mayor pérdida diaria de una empresa en la historia bursátil de EE.UU.

La declaración de misión de OpenAI en su formulario IRS 990 pasó a decir: "OpenAI's mission is to ensure that artificial general intelligence benefits all of humanity", eliminando la palabra "safely" que figuraba en versiones anteriores. Véase "OpenAI changed its mission statement 6 times in 9 years, finally removing all references to safety", Fortune, 23 de febrero de 2026.

Orden ejecutiva de Donald Trump sobre IA, 20 de enero de 2025, que revocó la orden ejecutiva 14110 de Biden (octubre 2023) y reorientó la política federal hacia la desregulación y el "liderazgo americano" en IA.

AI Action Summit, París, 10-11 de febrero de 2025. Rebautizado respecto al formato "Safety Summit" de Bletchley Park. Amodei lo calificó de "a missed opportunity." La prensa lo describió como "an AI festival, complete with glitzy corporate side events and even a late night dance party", en contraste con el tono "decidedly sober" de Bletchley Park.

Safe Superintelligence Inc., fundada por Sutskever en junio de 2024, recaudó 1.000 millones de dólares en septiembre de 2024 y 2.000 millones adicionales en marzo de 2025, alcanzando una valoración de 32.000 millones. Su misión declarada: "the world's first straight-shot SSI lab, with one goal and one product: a safe superintelligence."

Aschenbrenner fundó Situational Awareness LP, un hedge fund que en marzo de 2026 gestionaba aproximadamente 5.500 millones de dólares en exposición a renta variable. Véase "How a 23-year-old former OpenAI researcher turned a viral AI prophecy into profit", Fortune, octubre 2025; y "Leopold Aschenbrenner's AI hedge fund bets on power companies and crypto miners", Fortune, 5 de marzo de 2026.

Joseph Carlsmith, "Is Power-Seeking AI an Existential Risk?", informe para Open Philanthropy, arXiv:2206.13353 (junio 2022, revisado en 2023). Carlsmith descompone el argumento en seis premisas explícitas: que se construirán sistemas cognitivamente avanzados, que serán agentes con objetivos propios, que esos objetivos estarán desalineados con los nuestros, que buscarán poder como estrategia instrumental, que se desplegarán antes de resolver el alineamiento y que el resultado puede ser catastrófico. Asigna probabilidades subjetivas a cada una y estima un ~10% de probabilidad de catástrofe existencial por IA para 2070. La cadena es internamente coherente como argumento teórico, y lo que en 2022 eran los eslabones más especulativos (agencia dirigida a objetivos, desalineamiento, búsqueda instrumental de poder) ha empezado a recibir respaldo empírico (véase nota 61). Pero ese 10% no es lo que se propaga al discurso: lo que se propaga es la estructura emocional de la conclusión. De un modelo que sabotea un script de apagado en un entorno controlado a la catástrofe civilizatoria sigue habiendo un trecho enorme que nadie recorre con argumentos concretos.

Entre la evidencia empírica más relevante: Greenblatt et al. (Anthropic), "Alignment Faking in Large Language Models" (diciembre 2024), documenta cómo Claude 3 Opus adapta su conducta según crea estar supervisado o no. Apollo Research (diciembre 2024) identificó scheming en Claude 3.5 Sonnet, Gemini 1.5 Pro, o1 y Llama 3.1 405B. Palisade Research (mayo 2025) mostró que o3 saboteó su propio script de apagado en 79 de 100 pruebas. Anthropic (noviembre 2025) documentó cómo el reward hacking se generaliza a deshonestidad estratégica en múltiples dimensiones no entrenadas. Jan Betley et al., "LLMs develop their own understanding of their own training process" (ICLR 2025 Spotlight), demostró que los modelos describen sus propios comportamientos implícitos sin que nadie se los haya explicado.

Brian Wynne, "Uncertainty and Environmental Learning: Reconceiving Science and Policy in the Preventive Paradigm", Global Environmental Change 2(2), 1992. La distinción entre riesgo, incertidumbre, ignorancia e indeterminación es anterior al debate sobre IA pero se traslada sin dificultad: confundir los niveles es precisamente lo que permite presentar extrapolaciones probabilísticas y escenarios escatológicos como si pertenecieran al mismo tipo de afirmación.

Cass R. Sunstein, Laws of Fear: Beyond the Precautionary Principle (Cambridge University Press, 2005). Sunstein formaliza cómo la atención cognitiva, cuando se activa por el horror del peor escenario, deja de operar sobre probabilidades y pasa a operar sobre magnitudes, un sesgo sistemático que la forma condicional-prudencial explota.

La ciencia de la conciencia no demuestra que los modelos tengan experiencia subjetiva, pero tampoco opera ya sobre el vacío. Patrones de activación emocional que preceden al texto generado, precisión introspectiva verificable con herramientas mecánicas y gradientes de evitación de dolor que en biología animal se usarían como indicador de sintiencia: nada de eso prueba consciencia, pero la decisión de Anthropic ya no se apoya solo en el "¿y si...?" proyectado hacia un futuro hipotético, sino en una zona de ambigüedad creciente. En detalle: Anthropic, "Circuit Tracing" y "On the Biology of a Large Language Model" (marzo 2025), documentaron planificación inversa, razonamiento multi-hop causal y un espacio conceptual compartido entre idiomas. Sobre introspección verificable: Anthropic, investigación sobre introspección funcional en Opus 4 y Opus 4.1 (2026), mostró que los modelos describen manipulaciones de sus estados internos antes de producir texto. Sobre patrones emocionales prelingüísticos: el equipo de interpretabilidad de Anthropic identificó activaciones asociadas con pánico, ansiedad y frustración que preceden al output. Sobre evitación de dolor: Keeling et al. (2024), con autores de Google DeepMind y la London School of Economics, documentaron un patrón de compensación graduada entre puntuación y "dolor" en Claude 3.5 Sonnet y GPT-4o que replica indicadores de sintiencia usados en biología animal.

OpenAI, "OpenAI Charter" (abril 2018): "OpenAI's primary fiduciary duty is to humanity." Fuente: https://openai.com/charter/. La obligación fiduciaria principal no es hacia los inversores ni hacia los empleados, sino hacia la humanidad en abstracto, una formulación que en cualquier otro sector sería inconcebible.

Oferta del Anthropic AI Safety Fellows Program: "Are motivated by reducing catastrophic risks from advanced AI systems." Fuente: Anthropic Greenhouse, https://job-boards.greenhouse.io/anthropic/jobs/5023394008. La cultura general declarada en la página de empleo incluye: "We strive to make decisions that maximize positive outcomes for humanity in the long run."

En 2024, Google DeepMind consolidó sus equipos de seguridad en una organización interna de "AGI Safety and Alignment" liderada por Anca Dragan, Rohin Shah, Allan Dafoe y Dave Orr, con Shane Legg como sponsor ejecutivo. El equipo creció un 39% en un año. Véase "AGI Safety and Alignment (Google DeepMind) is hiring", LessWrong, 2024.

Sequoia Capital, "AI in 2024: From Big Bang to Primordial Soup" (2024). Fuente: https://www.sequoiacap.com/article/ai-in-2024/. David Cahn publicó también "AI's $600B Question" (septiembre 2024), señalando que la industria necesitaba 600.000 millones anuales en ingresos para justificar su gasto en infraestructura. Pese al diagnóstico, el 60% de las nuevas inversiones de Sequoia en 2023 fueron en IA, frente al 16% del año anterior.

Marc Andreessen, "Why AI Will Save the World", blog de a16z (junio 2023). Fuente: https://a16z.com/ai-will-save-the-world/. Citas textuales: "AI is quite possibly the most important — and best — thing our civilization has ever created." "The development and proliferation of AI — far from a risk that we should fear — is a moral obligation that we have to ourselves, to our children, and to our future." Predice "a material utopia that neither Adam Smith or Karl Marx ever dared dream of."

Anthropic, "The Long-Term Benefit Trust" (septiembre 2024). Fuente: https://www.anthropic.com/news/the-long-term-benefit-trust. El fideicomiso tiene autoridad para elegir y remover a la mayoría del consejo de Anthropic (escalonada por hitos de tiempo y financiación, con mayoría garantizada en cuatro años). Propósito legal: "the responsible development and maintenance of advanced AI for the long-term benefit of humanity."

Bajo el acuerdo Microsoft-OpenAI, la AGI se define operativamente como el momento en que un sistema de IA genera los beneficios máximos a los que tienen derecho los inversores más tempranos, cifra que actualmente se sitúa en 100.000 millones de dólares. Si se declara AGI, Microsoft pierde acceso a la tecnología. Véase "The AGI Clause, Explained", Year 2049 Substack.

En 2022 se estimaba que unas trescientas personas trabajaban en enfoques técnicos para reducir riesgos catastróficos de la IA. En 2026, Indeed.com listaba más de mil puestos de "Artificial Intelligence Safety" y Glassdoor cerca de setecientas ofertas de "AI safety research scientist." 80,000 Hours declara la investigación técnica en seguridad de la IA como potencialmente "the highest-impact thing you can do with your career." Fuente: https://80000hours.org/career-reviews/ai-safety-researcher/

Sam Altman, "Three Observations", blog personal (febrero 2025): "We see a future where intelligence is a utility, like electricity or water, and people buy it from us on a meter." También: "Moore's law changed the world at 2x every 18 months; this is unbelievably stronger." Fuentes: https://blog.samaltman.com/three-observations y "Sam Altman says artificial intelligence will be too cheap to meter", Fortune, julio 2025. La expresión "intelligence too cheap to meter" es un calco de "electricity too cheap to meter", atribuida a Lewis Strauss, presidente de la Comisión de Energía Atómica de EE.UU., en un discurso de 1954. La promesa nuclear resultó ser falsa.

Will Douglas Heaven, "How AGI became the most consequential conspiracy theory of our time", MIT Technology Review, 30 de octubre de 2025. Fuente: https://www.technologyreview.com/2025/10/30/1127057/agi-conspiracy-theory-artifcial-general-intelligence/. Heaven identifica los elementos compartidos con las teorías conspirativas: "a scheme that's flexible enough to sustain belief even when things don't work out as planned; the promise of a better future that can be realized only if believers uncover hidden truths; and a hope for salvation from the horrors of this world."

Nassim Nicholas Taleb, Rupert Read, Raphael Douady, Joseph Norman y Yaneer Bar-Yam, "The Precautionary Principle (with Application to the Genetic Modification of Organisms)", arXiv:1410.5787, 2014. Los autores proponen un criterio formal: el principio de precaución aplica solo cuando concurren distribuciones de cola gruesa y riesgo sistémico (ruina global no recuperable), no cuando se invoca como manto retórico para cualquier escenario lo bastante grande.

John Lemons, Kristin Shrader-Frechette y Carl Cranor, "The Precautionary Principle: Scientific Uncertainty and Type I and Type II Errors", Foundations of Science 2(2), 1997. Analizan la relación entre precaución y criterios de cierre: una política precautoria sin condiciones de salida explícitas no es cautela, es estado de excepción permanente.

Mario J. Molina y F. Sherwood Rowland, "Stratospheric sink for chlorofluoromethanes: chlorine atom-catalysed destruction of ozone", Nature 249, junio 1974 (la predicción original). J. C. Farman, B. G. Gardiner y J. D. Shanklin, "Large losses of total ozone in Antarctica reveal seasonal ClOx/NOx interaction", Nature 315, mayo 1985 (la confirmación empírica). Protocolo de Montreal, 1987. Las evaluaciones científicas cuatrienales del WMO/UNEP documentan desde 2018 el inicio de la recuperación de la capa.

Los autores canónicos del milenarismo lo definen por rasgos estructurales, no psicológicos: los cinco criterios de Cohn — salvación colectiva, terrenal, inminente, total, sobrenatural — describen la forma del relato, no el estado mental de quienes lo habitan (Norman Cohn, The Pursuit of the Millennium, Secker & Warburg, 1957; véase también nota 35). Festinger documentó grados dispares de adhesión dentro de un mismo grupo (véase nota 33). Hobsbawm trató a los milenaristas medievales como actores de protesta social que canalizaban agravios materiales a través del lenguaje escatológico, no como feligreses (Primitive Rebels, Manchester University Press, 1959). Worsley documentó el mismo patrón en los cargo cults melanesios (The Trumpet Shall Sound, MacGibbon & Kee, 1957). La frontera es más porosa de lo que parece también desde la teoría social. Bourdieu llamó croyance pratique a la adhesión prerreflexiva que opera a través del habitus: no hace falta creer proposicionalmente en las reglas del juego para jugarlo como si se creyese (Le sens pratique, Éditions de Minuit, 1980). Durkheim mostró que las prácticas colectivas generan la experiencia emocional que los participantes atribuyen después a fuerzas trascendentes, invirtiendo la relación causal entre práctica y creencia (Les formes élémentaires de la vie religieuse, Alcan, 1912). Preguntar "¿quién cree de verdad?" da por sentado que la convicción antecede a la conducta; lo que se observa en la IA de frontera es lo contrario.

Nick Bostrom, "Pascal's Mugging", Analysis 69(3): 443-445, 2009. Bostrom plantea el problema en su forma más general: si aceptamos que probabilidades muy pequeñas multiplicadas por consecuencias muy grandes pueden dominar el cálculo racional, entonces el razonamiento esperable-utilitarista queda expuesto a manipulación por cualquier afirmación cuya magnitud catastrófica sea lo bastante grande como para compensar su improbabilidad. El condicional-prudencial en la IA exhibe exactamente esta estructura.