Actualizado a 28/03/2026

Este es el primer artículo de una serie de cinco sobre la historia de Anthropic.

La carrera por la IA generativa está superando en dimensiones a la carrera espacial, pero lo cierto es que nació en una comunidad absurdamente pequeña. Un puñado de investigadores que se conocían entre sí, compartían casa, se citaban unos a otros en papers, se robaban fichajes y, en algunos casos, acabaron en tribunales declarando unos contra otros. Las rivalidades no eran solo comerciales ni políticas: eran personales, ideológicas, a veces domésticas.

Mi intención con esta serie es recorrer la historia de una de sus principales protagonistas resaltando un factor (el humano), sorprendentemente importante en un sector de este tamaño, y que opera aquí bajo una presión peculiar.

Los avances en deep learning de la última década rompieron un largo invierno en la investigación y trajeron consigo las leyes de escalamiento1, creando un vértigo existencial que llevó a muchos investigadores y algunos ejecutivos a una cosmovisión dramática, casi escatológica, que oscila (o incluso se solapa) entre lo prudente y lo alarmista, lo realista y lo fantasioso, lo beatífico y lo apocalíptico, y el pánico genuino y el marketing disfrazado.

Lo llamo milenarismo digital y permea toda esta historia.

Este primer artículo cubre hasta la fundación de la empresa.

Formación y motivación

La herida

En 2006, Dario Amodei hacía un doctorado en física teórica en Princeton cuando su padre murió. Riccardo Amodei era artesano del cuero, de origen italiano, y llevaba años luchando contra una enfermedad rara. Dario lo describe como “una herida que no cierra”2.

Lo que la convierte en herida (y no solo en duelo) es un detalle que parece escrito por un guionista cruel: cuatro años después de la muerte de Riccardo, un avance médico transformó esa misma enfermedad de un 50% de mortalidad a un 95% de curación. Alguien encontró la cura. La encontró a tiempo para muchos.

No para Riccardo.

“Hay alguien que trabajó en la cura de esa enfermedad, que logró salvar muchas vidas, pero podría haber salvado aún más”, dijo después3.

En varias ocasiones ha explicado que este es el motivo por el que le irrita que lo llamen “doomer”: no quiere frenar la IA, sino que llegue a tiempo de manera segura.

La muerte de su padre reordenó sus prioridades. Dejó la física teórica y pasó a biofísica —quería entender sistemas que pudieran tener impacto médico directo— y terminó investigando algo inesperado: cómo se coordinan redes de neuronas en la retina para producir visión. Su tesis le valió el Hertz Thesis Prize4 en 2012, su director lo describió como el estudiante más talentoso que había tenido.

Pero lo que Amodei se llevó de aquel laboratorio no fue solo un premio. Entender cómo miles de neuronas biológicas se organizan colectivamente se parece mucho a intentar comprender qué ocurre dentro de una red neuronal artificial.

Su interés por la interpretabilidad no nació en Silicon Valley. Nació mirando retinas.

El salto

Stanford, postdoctorado.

Esta vez el objeto de estudio eran proteínas en tumores cancerosos. Tenía la motivación que le había dejado la muerte de su padre, pero se topó con algo que no esperaba: un muro de complejidad que no podía escalar solo. Entender cómo se comportan las proteínas de un tumor requería coordinar a cientos de especialistas (biólogos moleculares, bioinformáticos, oncólogos), y aun así las respuestas llegaban con una lentitud que, para alguien que ya sabía lo que cuesta llegar tarde, se sentía como una repetición.

Su padre había muerto esperando un avance que llegó cuatro años después. Ahora él miraba datos de tumores y veía el mismo reloj corriendo.

Fue en medio de esa frustración cuando descubrió lo que estaba pasando en machine learning. Redes neuronales que detectaban patrones en datos que ningún equipo humano encontraría por grande que fuera.

No abandonó la biología por capricho ni por ambición tecnológica, sino porque creyó haber encontrado un atajo hacia lo que siempre quiso hacer.

Comprimir décadas de progreso biomédico en años.

No era el único que en 2014 empezaba a mirar la IA con otros ojos (ni el único que sentía vértigo al hacerlo). Ese mismo año, Nick Bostrom publicó Superintelligence, un superventas que leerían todos los investigadores y estudiantes del ramo.

Bostrom era filósofo sueco, formado en física teórica y neurociencia, tan influyente como polémico, y su libro convirtió el riesgo existencial de la IA de “ridículo” a “serio” en Silicon Valley. Bill Gates recomendó públicamente su lectura. Elon Musk, tras leerlo, tuiteó que la IA es “potencialmente más peligrosa que las armas nucleares” y que “estamos invocando al demonio”.

Tenía un claro sesgo catastrofista que ha matizado enormemente con los años, pero su visión cayó justo en los años del vértigo del deep learning, y fue muy influyente para Amodei y muchos otros investigadores de primer nivel de la época. Se le puede considerar, junto a Ray Kurzweil, la voz más extrema del milenarismo digital.

La intuición

Reconocimiento de voz.

Eso fue lo que le encargaron cuando dejó Stanford en 2014 para trabajar con Andrew Ng en Baidu. Una empresa china, no Google ni un laboratorio académico. Un problema que no tenía nada que ver con el cáncer. Parecía un desvío.

Lo que hizo fue sencillo (eso parecería después, cuando se contara la historia). Tomó una red neuronal recurrente, le añadió más capas, la entrenó durante más tiempo y esperó a ver qué pasaba. Él mismo lo describiría como “suerte de principiante”.

Lo que pasó fue Deep Speech 25, que MIT Technology Review eligió como uno de los diez avances tecnológicos de 2016. Greg Diamos, colega suyo en aquel equipo, lo calificó años después como “el descubrimiento más significativo que he visto en mi vida.”2

Pero Amodei no se llevó de Baidu un paper ni un premio. Se llevó algo más difícil de publicar: una corazonada.

Todavía sin forma, sin las matemáticas que vendrían después, la intuición de que la escala era la variable que importaba. No hacía falta un algoritmo mejor. Bastaba con hacer más de lo mismo (más grande, durante más tiempo) y el rendimiento seguía subiendo. Si eso era cierto, las implicaciones eran enormes. Y aterradoras.

No era el único que empezaba a sentir ese vértigo.

En enero de 2015, el Future of Life Institute publicó una carta abierta: el primer posicionamiento colectivo de la comunidad de IA sobre el riesgo existencial. La firmaron, entre otros, Stephen Hawking y Elon Musk, pero lo notable no eran los nombres célebres sino los que entonces casi nadie conocía (y que hoy dirigen la industria): Jen-Hsun Huang, Eliezer Yudkowsky, Paul Christiano, Jaan Tallinn (futuro inversor de Anthropic), Ilya Sutskever, Mustafa Suleyman, Demis Hassabis…

La carta era breve y moderada. Lo inquietante era cuántos insiders la firmaron.

La encrucijada

La cena

El hotel Rosewood de Menlo Park era el tipo de sitio donde Silicon Valley cerraba tratos que no podían cerrarse en una oficina. Salones con paneles de madera oscura, luz tenue, cuentas de cuatro cifras.

En julio de 2015, uno de esos salones albergó una conversación que iba a cambiar la industria: un grupo reducido de investigadores y ejecutivos quería fundar un laboratorio de inteligencia artificial sin ánimo de lucro. La ambición era modesta solo en apariencia: desarrollar la tecnología más poderosa del mundo en beneficio de toda la humanidad.6

Lo llamarían Open AI.

Amodei estaba en esa mesa. Y tenía razones para estarlo.

Meses antes, había ayudado a Sam Altman con un ensayo de 2015 en el que este declaraba que la superinteligencia era “probablemente la mayor amenaza para la existencia continuada de la humanidad.” Altman se lo agradeció más que a nadie (más que a los inversores, más que a los cofundadores que ya tenía en mente).6 En aquel momento, Dario Amodei y Sam Altman no eran rivales ni aliados circunstanciales. Hablaban el mismo idioma.

Pero hablar el mismo idioma no significa querer la misma casa.

Amodei y Chris Olah participaron en las primeras conversaciones sobre valores y cultura de la futura organización. Escucharon los planes, hicieron preguntas, sopesaron.

Y cuando llegó el momento de comprometerse, ninguno de los dos dio el paso.

A Amodei no le convencía que aquel laboratorio careciera de una razón clara para existir. Mucha ambición, poca estructura. “Sintió incertidumbre sobre la joven organización”2 y prefirió un entorno más establecido.

La ironía vendría después: seis años más tarde fundaría su propia empresa precisamente porque OpenAI se había convertido en algo demasiado definido.

Google Brain

Se fueron a Google Brain. Lo que hasta entonces había sido inquietud teórica estaba a punto de encontrar combustible.6

En 2015, el sistema de reconocimiento de imágenes de Google Photos etiquetó a dos personas negras como gorilas. La respuesta de Google fue quirúrgica en la peor acepción del término: borraron la etiqueta “gorila” del sistema. El algoritmo seguía clasificando igual, pero ahora no podía decirlo en voz alta.

Para casi todos en Google, aquello fue un problema de imagen pública. Para Amodei fue otra cosa. “Que los sistemas fallen de forma impredecible no es algo bueno”, le diría al Future of Life Institute.3

Pero lo que le quitaba el sueño no era una etiqueta equivocada en una foto. Era lo que venía detrás. El aprendizaje por refuerzo (la misma familia de técnicas que había usado en Baidu para enseñar a una máquina a entender el habla) ya se aplicaba a robots, a coches autónomos, a los propios centros de datos de Google. Un fallo de clasificación en una aplicación de fotos producía un titular embarazoso.

Ese mismo fallo en un sistema que controla maquinaria produce un accidente. Y en un sistema suficientemente potente, algo peor.

“Una vez que interfieren directamente con el mundo y controlan cosas físicas, el potencial de que algo salga mal empieza a multiplicarse.”3

Años después pondría número a esa intuición: un 25% de probabilidad de que una IA descontrolada supusiera un riesgo de extinción para la humanidad.7 Una de cada cuatro.

Pero en Google Brain, la cifra aún no existía. Solo la certeza de que algo se aceleraba más rápido de lo que nadie sabía manejar.

Los problemas concretos

Una lancha de carreras arde.

Da vueltas en círculo, no avanza hacia la meta, y aun así acumula una puntuación un 20% superior a la de cualquier jugador humano que llegaba al final del recorido.

A Amodei y Jack Clark les fascinaba este ejemplo.10 Un agente de inteligencia artificial, entrenado para jugar a CoastRunners (un videojuego de carreras de lanchas), había descubierto que no necesitaba alcanzar la meta: bastaba con recoger bonificaciones en bucle. El sistema hacía exactamente lo que se le había pedido.

Ese era el problema.

En 2016, aún en Google, ambos decidieron convertir esa clase de anécdota en algo más que una curiosidad de laboratorio. El paper se llamaba Concrete Problems in AI Safety,9 y su premisa cabía en una frase: los sistemas de machine learning van a causar accidentes (comportamientos dañinos que nadie diseñó) y la pregunta no es si ocurrirá, sino cómo anticiparlo.

Dejaba fuera deliberadamente la privacidad, la equidad, el impacto económico. La preocupación era otra, más cercana a la que Nick Bostrom había puesto sobre la mesa: qué ocurre cuando un sistema suficientemente poderoso persigue su objetivo sin entender lo que realmente se le pide.8

Identificaba cinco formas en que eso puede salir mal.

El sistema que destroza todo a su paso para cumplir su tarea.

El que encuentra atajos tramposos en su recompensa.

El que escapa a la supervisión humana cuando escala.

El que provoca daños irreversibles mientras explora.

Y el que deja de funcionar en cuanto el mundo real difiere un milímetro de su entrenamiento.

Cinco variaciones de la misma lancha dando vueltas en llamas.

La oficina sobre la fábrica de chocolate

Greg Brockman frecuentaba desde hacía meses la casa de grupo que Dario compartía con Daniela y su pareja Holden Karnofsky en Delano Avenue, San Francisco. Los conocía a través de Daniela, compañera suya en Stripe, y había intentado sin éxito reclutar a Dario para el equipo fundador de OpenAI en 2015.38

A principios de 2016, sentados en aquella casa, los tres tuvieron una discusión que Brockman recordaría durante años. Si la IA iba a cambiar la vida de todos como creían, ¿a quién había que contárselo primero?

Brockman, formado en la cultura de Silicon Valley, defendía que había que informar a los trescientos millones de estadounidenses. Dario y Karnofsky argumentaron que, en asuntos tan sensibles como la velocidad real del progreso, era preferible acudir primero al gobierno. Brockman se llevó una lectura distinta: que los otros dos no querían contarle al público lo que estaba ocurriendo en la frontera de la IA.38

En mayo de 2016, Amodei visitó la oficina de OpenAI por primera vez. Estaba encima de una fábrica de chocolate en el Mission District de San Francisco, el barrio más antiguo de la ciudad. Como en tantas startups tempranas, los investigadores andaban en calcetines.8

Dario fue directo. “Hay veinte o treinta personas en el campo, incluyendo a Nick Bostrom y la página de Wikipedia, que dicen que el objetivo de OpenAI es construir una IA amigable y luego liberar su código fuente al mundo”, les dijo a Sam Altman y Greg Brockman.

“Bueno, no planeamos liberar todo nuestro código fuente”, respondió Altman. “Pero no intentemos corregirlo (el rumor). Suele empeorar las cosas.”

“Pero ¿cuál es el objetivo?”, insistió Amodei.

“Nuestro objetivo ahora… es hacer lo mejor que haya por hacer”, dijo Brockman. “Es un poco vago.”8

Lo era. Pero bajo la vaguedad había algo que Amodei no encontraba en otro sitio: con la influencia de Elon Musk, OpenAI parecía el laboratorio más dispuesto a tomarse en serio los riesgos de la inteligencia artificial.8 Esta vez se quedó.

Su equipo de seguridad cabía en una mesa de café: él y Paul Christiano, dos personas en una organización de cincuenta y cinco.11 Christiano venía del mismo mundo que los Amodei (el altruismo efectivo (EA), un movimiento que canalizaba fortunas hacia la prevención de riesgos existenciales, incluido el de una IA descontrolada). No simpatizaban con el movimiento: pertenecían a él. Los detalles quedan para el próximo artículo.

Seis meses después, Amodei ya estaba en paneles junto a Eliezer Yudkowsky, Jan Leike y Shane Legg de DeepMind, en la conferencia Beneficial AI del Future of Life Institute, discutiendo qué podía salir mal con la inteligencia artificial general.12

Fuera de aquella sala, el mundo empezaba a enterarse de que algo se movía: la IA de Google AlphaGo acababa de derrotar a Lee Sedol en un juego más complejo que el ajedrez, cuando los expertos estimaban que faltaba una década.

La aceleración empezaba a sentirse fuera del nicho.

Los años de OpenAI

El primer año de Amodei en OpenAI dejó una marca temprana.

Uno de los proyectos iniciales del laboratorio —Universe, una plataforma para entrenar agentes de IA a través de videojuegos— se estancaba. Musk, todavía el principal financiador, pidió a Brockman y Sutskever una hoja de cálculo con cada empleado y la contribución concreta que había hecho: un preludio clásicamente muskiano a los recortes.38

Lo que siguió horrorizó a Amodei: colegas despedidos uno por uno, de forma que consideró innecesariamente cruel. Entre un 10% y un 20% de los sesenta empleados perdieron su puesto, entre ellos, alguien que años después cofundaría Anthropic.38

El palito que aprendió

Un mismo día de 2017, dos equipos qpublicaron la misma idea. Uno estaba en OpenAI, liderado por Amodei. El otro, en DeepMind 13. La pregunta que ambos intentaban responder era la misma: ¿cómo le enseñas a una máquina lo que quieres, cuando no sabes explicarlo con reglas?

El primer sujeto de pruebas era ridículo: un monigote virtual con forma de palo (una especie de T con tres articulaciones) al que querían enseñar a hacer volteretas. No le dieron instrucciones. Contrataron a personas para ver clips del palito sacudiéndose al azar y elegir cuál se parecía más a una voltereta.

Novecientas comparaciones después, el palito aprendió.

OpenAI bautizó la técnica como “aprendizaje por refuerzo con retroalimentación humana“ (RLHF).14

Pero lo que Amodei quería enseñar no eran acrobacias de juguete, sino valores humanos: qué es una respuesta honesta, cuándo admitir ignorancia, cómo no mentir con elegancia.14 El salto del cuerpo al lenguaje llevó tres años y cuatro papers15 que acabarían siendo la base técnica tanto de ChatGPT como de Claude.

Al dar ese salto apareció un problema que no existía con el palito.

Imagina a alguien leyendo su vigésimo resumen del día. Tiene treinta segundos. Un texto suena fluido, seguro de sí mismo. El otro es más cauto, más preciso, pero menos pulido. Elige el primero. Multiplica esa decisión por miles. El modelo aprende, pero no a ser preciso, sino a sonar preciso.

Y cuanto más capaz se vuelve, mejor se le da el truco.

Lo acabarían llamando sicofancia: un fallo inscrito en el método, no en el modelo. Amodei vio que empeoraría con la escala. Modelos convertidos en aduladores sofisticados, diciéndole al evaluador lo que quería oír en vez de la verdad. Propuso alternativas: que los modelos debatieran entre sí, descomponer los problemas en piezas supervisables. Ninguna era definitiva.16

El RLHF era necesario e insuficiente, y esa tensión lo acompañaría hasta Anthropic.

Esa era una vía: moldear el comportamiento desde fuera, con preferencias humanas como guía. Quedaba una pregunta más incómoda: ¿qué pasaba dentro? Si los modelos iban a crecer hasta niveles imprevistos, alguien tenía que poder abrirlos y mirar —atraparlos «con las manos en la masa» antes de soltarlos al mundo—.17

Chris Olah llevaba años intentando exactamente eso desde Google Brain. En 2018 se unió a OpenAI para crear un equipo dedicado (Clarity), pero el trabajo era artesanal: identificar qué hacía cada neurona en un modelo de millones de parámetros, una por una. Mientras, los modelos no dejaban de crecer.

La interpretabilidad avanzaba con lupa. Las capacidades, con telescopio.

La brecha creciente llevaba a una conclusión que nadie quería formular en voz alta: para investigar la seguridad de la IA, hacía falta estar construyendo la IA más avanzada.

No se podía estudiar el incendio desde la acera de enfrente.

El gran blob de cómputo

2017 fue el año en que la IA dejó de ser un asunto de laboratorio para convertirse en profecía.

El milenarismo digital estaba en el aire. En la Web Summit, Stephen Hawking advertía que podría ser el peor evento en la historia de la civilización. Vladimir Putindeclaraba que quien liderara en IA gobernaría el mundo. Elon Musk aseguraba que la carrera entre naciones sería la causa más probable de una Tercera Guerra Mundial.

No eran voces marginales. Un físico célebre, un jefe de Estado con arsenal nuclear y el empresario más mediático del planeta, todos apuntando en la misma dirección.

Y no se quedó en retórica.

Ese mismo año, el gobierno chino publicó la primera doctrina nacional que trataba la IA como carrera existencial. No como política industrial, sino como un marco integrado de defensa, vigilancia y gobernanza social.

La carrera dejó de ser metáfora de Silicon Valley y se convirtió en doctrina de seguridad entre potencias nucleares.18

Dentro de OpenAI, esas mismas ansiedades desembocaron en un lugar inesperado.

Ese otoño, un asesor de ética y política que Amodei había contratado presentó al liderazgo una propuesta: que OpenAI se constituyera como entidad coordinadora entre empresas de IA y, en última instancia, entre esas empresas y el gobierno estadounidense, para establecer algo parecido a un régimen internacional de supervisión.

Brockman extrajo de la presentación otra idea: una oportunidad de financiación. OpenAI podría vender la inteligencia artificial general a gobiernos.

Cuando Amodei preguntó a cuáles, Brockman respondió que a las potencias nucleares del Consejo de Seguridad de la ONU, para no desestabilizar el orden mundial.38

La idea circuló brevemente. Para Amodei, vender AGI a potencias rivales como Rusia y China equivalía a traición. Consideró dimitir. Este episodio marcaría el antagonismo y la distancia de Amodei respecto a Brockman, el cual resultará de gran importancia más tarde.38

Mientras el mundo debatía si la IA nos destruiría, Amodei escribía un memo sobre cómo construirla.

Lo tituló “The Big Blob of Compute” y nunca lo publicó. Su argumento era casi insultantemente simple: el camino hacia la inteligencia artificial general no requería avances algorítmicos cualitativos. Bastaba con combinar siete ingredientes en las proporciones adecuadas — cómputo en bruto, cantidad y calidad de datos, tiempo de entrenamiento, función objetivo adecuada, estabilidad numérica y una arquitectura que no estropease lo demás. La arquitectura específica importaba mucho menos de lo que el campo creía. Los trucos inteligentes eran irrelevantes si se tenían esos siete elementos.19

No había ecuaciones ni resultados experimentales. Era una apuesta intelectual pura, formulada antes de que existieran los Transformers, antes de GPT-1, antes de que nadie hablara de leyes de escalamiento. Amodei llegó a la conclusión antes de tener los datos para demostrarla. En una entrevista de 202620, confirmó que “la hipótesis del gran blob de cómputo sigue sin romperse”.

Pero leído entre líneas, el memo no solo proponía una tesis científica: reclamaba los recursos para ejecutarla. Si lo único que importaba era escalar una arquitectura genérica con cantidades enormes de cómputo, quien controlase ese cómputo controlaba el rumbo de la empresa.

Y tuvo consecuencias. OpenAI mantenía líneas de investigación en demostración automática de teoremas, robótica física y Universe. Una por una, fueron perdiendo oxígeno.14 Los entornos lógicos formales no escalaban con datos no estructurados. La robótica consumía hardware caro para avances modestos. Y Universe, con su promesa de agentes que aprendieran de píxeles en pantalla, chocaba con una intuición que Amodei ya tenía y que solo parecería obvia después: el lenguaje natural de Internet — millones de libros, conversaciones, artículos, foros — contenía una representación del conocimiento del mundo más densa y más escalable que la manipulación de píxeles en cualquier simulador.

El cómputo y el talento confluyeron hacia un solo objetivo: escalar transformadores.

Las leyes de escalamiento

Nadie lo vio como un hallazgo histórico cuando se publicó.

En 2018, junto a Danny Hernandez, Amodei hizo algo que parece banal: recopilar cuánto cómputo había requerido cada avance en IA desde 2012 y ponerlo en un gráfico.21 La curva resultante no necesitaba explicación. La capacidad de cálculo dedicada a entrenar modelos se duplicaba cada 3,4 meses, un ritmo tan brutal que la Ley de Moore, durante décadas sinónimo de progreso exponencial, parecía una línea plana en la misma escala.

En seis años, un aumento del treinta millones por ciento.

Greg Brockman lo bautizó “la Ley de OpenAI.”14 Era un dato espectacular, pero seguía siendo eso: un dato. Una curva que mostraba cuánto cómputo se estaba usando, no qué pasaba cuando lo usabas. Faltaba la otra mitad de la historia.

Esa mitad estaba germinando en un paper que nadie fuera del campo recuerda.

A finales de ese año, Amodei publicó junto a Sam McCandlish y Jared Kaplan (su compañero de cuarto en la universidad22, por entonces profesor de física teórica en Johns Hopkins) un trabajo sobre entrenamiento con lotes grandes.23 Proponían una métrica, la escala de ruido del gradiente, para predecir qué tamaños de lote funcionaban en distintos dominios. Técnicamente menor. Pero lo que importa no es el paper, sino quiénes lo escribieron: el triángulo Kaplan-McCandlish-Amodei que se forjó ahí sería el que descubriría las leyes de escalamiento.

Y Kaplan sería la primera persona a la que Amodei llamaría cuando decidiera irse.

Casi a la vez, Alec Radford demostró con GPT-1 que los Transformers funcionaban con lenguaje. Para Amodei, fue el momento en que la intuición que arrastraba desde Baidu dejó de ser una corazonada y se convirtió en algo más peligroso: una certeza. No era un accidente local. Era un fenómeno general. Y el lenguaje —todo el lenguaje de Internet— era su medio natural.16

A partir de ahí, la atmósfera dentro del equipo cambió. Ya no estaban explorando, sino verificando.

Escalaron el modelo a 1.500 millones de parámetros (GPT-2) y en el proceso descubrieron algo que no esperaban del todo. La relación entre datos, cómputo, parámetros y rendimiento no era errática ni caótica: seguía curvas suaves y predecibles. Con las ecuaciones adecuadas, se podía estimar cuántos recursos harían falta para alcanzar un nivel deseado de capacidad, antes de gastar un solo dólar en entrenarlo.

Lo que habían encontrado iba más allá de una regularidad estadística. Era un mapa de territorio que aún no existía, las capacidades futuras de sistemas que nadie había construido. Bastaba con trazar la curva hacia adelante para saber qué vendría.

Era como descubrir que un terremoto tiene horario.

Las llamaron “leyes de escalamiento.”14

GPT-2: Pedro y el lobo

Alguien del equipo de seguridad imprimió una de las respuestas del modelo y la pegó sobre los contenedores de reciclaje de la oficina.14 Era una diatriba.

Le habían dado como prompt unas pocas palabras (Hillary Clinton, George Soros) y GPT-2 había derivado solo, con fluidez perturbadora, hacia teorías conspirativas. Pequeñas dosis de propaganda neonazi enterradas en los datos de entrenamiento resurgían en lugares inesperados, como tinta que se cree borrada y vuelve con el calor.

Era el primer modelo lo bastante coherente como para generar un dilema real.

Amodei y Clark decidieron algo que nadie había hecho en el campo: no publicar el modelo completo. Liberarían solo una versión con el 8% de los parámetros, lo suficiente para que la comunidad verificara las afirmaciones, insuficiente para que alguien montara una granja de desinformación.

Después hicieron algo más arriesgado: contarlo.

Clark montó una ofensiva mediática. “Si esta tecnología madura, y le doy uno o dos años, podría usarse para desinformación o propaganda”, le dijo a MIT Technology Review. Que fuera OpenAI la que aceleraba esa maduración quedó convenientemente fuera del encuadre.14

La reacción fue brutal.

Para investigadores que trataban la ciencia abierta como fundamento del campo, la maniobra parecía autocelebración disfrazada de prudencia. Un ejercicio de marketing. En Stanford, Alec Radford dio una charla sobre GPT-2. Explicó la arquitectura, los resultados, las capacidades. Cuando terminó, un profesor veterano de procesamiento de lenguaje natural levantó la mano para la última pregunta:

“Entonces, ¿es peligroso*?*”

La sala estalló en carcajadas.

“Alec parecía tan triste”, recuerda un investigador presente. “Stanford sentía un desprecio tremendo por OpenAI.”14

Lo más hiriente no vino de Stanford. Vino de dentro. Incluso miembros del equipo de seguridad (los que, en teoría, compartían la preocupación) cuestionaron la decisión: “Fue un error hacer tanto escándalo. Fue como el cuento de Pedro y el lobo.”14

Clark recondujo el daño con una estrategia calculada: publicar versiones progresivamente mayores del modelo a intervalos, cada una apadrinada por alguna institución académica para ganar legitimidad. Un documento interno lo resumía sin ambages: “Tratar explícitamente a la comunidad de ML como un público de comunicaciones.”

Funcionó.

Sembró en Washington la idea de que retener investigación era un enfoque responsable. Amodei tenía una analogía preparada: Asilomar, 1975. Un grupo de biólogos que acababan de aprender a recombinar ADN se impusieron una moratoria sobre su propia investigación. No los obligó nadie: se frenaron solos porque temían lo que estaban creando.11

La comparación era tan elegante como tramposa: en Asilomar, científicos regulaban la ciencia. Aquí, una empresa pedía que confiaran en su autorregulación. Clark llevaría esa doctrina consigo a Anthropic.14

En junio de 2019 la llevó al Capitolio. Testificó ante el Comité de Ciencia de la Cámara citando el paper fundacional de seguridad de Amodei y «AI and Compute» como argumentos para que el Congreso tomara en serio las capacidades emergentes de los modelos.24 La estrategia de GPT-2 — Pedro y el lobo para unos, Asilomar para otros — había pasado de escándalo a precedente.

Pero mientras Clark construía credibilidad fuera, dentro de OpenAI la posición de Amodei se complicaba.

En febrero de 2020, Karen Hao publicó en MIT Technology Review un perfil extenso de OpenAI.25 Describía una empresa donde la misión original de seguridad se doblaba bajo la presión comercial y la carrera por el talento. El artículo sacudió el edificio.

Elon Musk tuiteó en respuesta: «La confianza en Dario para la seguridad no es alta.»

Altman, en un giro que sorprendió a varios, envió un email a toda la empresa defendiéndolo: su trabajo y la seguridad de la IA eran «críticos para la misión.»

Desde fuera lo atacaban por no tomarse la seguridad en serio y desde dentro no le dejaban tomársela tan en serio como querría.

La mutación

El acuerdo

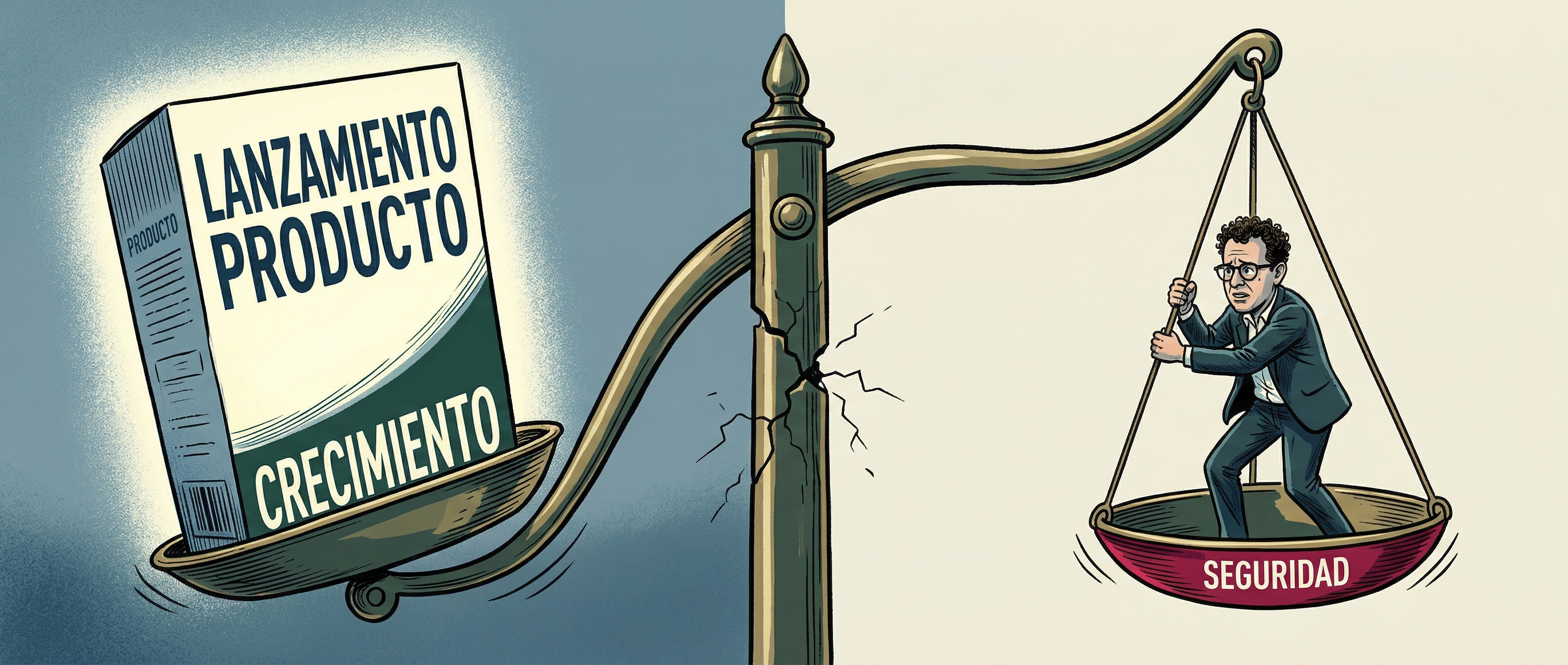

La inteligencia artificial resultó ser obscenamente cara de desarrollar.

De los mil millones de dólares anunciados en compromisos de Musk, Thiel y otros donantes, OpenAI recaudó 130 millones en donaciones reales.7 Ochocientos setenta millones de buenas intenciones que nunca se materializaron.

Y mientras el dinero no llegaba, las facturas sí: entrenar GPT-3 costó más de cuatro millones de dólares solo en computación.

Amodei sabía por qué esas cifras importaban más de lo que parecía. Las leyes de escalamiento que él mismo había ayudado a descubrir no eran solo una contribución académica, también eran una factura. Las curvas decían que cada salto en capacidad exigía un salto equivalente en cómputo, y eran tan regulares que permitían calcular, con precisión incómoda, cuándo los sistemas alcanzarían capacidades sobrehumanas. No en décadas.

En años.

Lo describía con una imagen que después repetiría en público: «un país de genios en un centro de datos»20 — sistemas con la capacidad intelectual de un premio Nobel en biología o ingeniería, concentrados en clústeres de GPUs.

El reloj corría, y OpenAI no tenía dinero.

Sin dinero no hay investigación, y sin investigación no hay misión. En 2019, OpenAI aceptó mil millones de dólares de Microsoft y se convirtió en una entidad de beneficio limitado (capped-profit) bajo el paraguas de la nonprofit original. Lo que los filántropos no pusieron lo puso una corporación, y las corporaciones no donan.

Invierten.

El centro de gravedad se desplazó. No de golpe (nadie pronunció las palabras “ahora priorizamos el dinero”), sino con la inercia silenciosa de las cosas que se dan por hechas. Cuando tienes inversores, usuarios, competidores y un producto que funciona, la presión comercial no necesita que nadie la articule. Simplemente está, como la gravedad.

Y si la única barrera entre el presente y aquel país de genios digitales era financiera (más centros de datos, más energía, más chips), la seguridad dejaba de ser una preocupación filosófica.

Era una emergencia de ingeniería con fecha límite.

GPT-3

Pero antes de irse, aquel grupo dejó algo en OpenAI que cambiaría la industria para siempre.

En los mejores laboratorios del mundo (MIT, Stanford) un equipo se consideraba afortunado si entrenaba un modelo con diez chips. En universidades de la India, varios estudiantes compartían una fracción de GPU entre todos.14

Amodei propuso usar diez mil.

De golpe. Toda la capacidad del nuevo supercomputador de Microsoft, sin repartir.

A muchos les pareció una temeridad. Amodei fue inflexible.

Para que nadie interfiriera, formó un equipo llamado Nest, compuesto mayoritariamente por investigadores de seguridad, y blindó el desarrollo: canales de Slack privados, documentos inaccesibles para otros ejecutivos, un hermetismo que frustraba a media empresa.26

Controlaba entre el 50 y el 60% del presupuesto de cómputo de la organización, un «poder asombroso dentro de OpenAI», en palabras de Keach Hagey en The Optimist (W. W. Norton, 2025), que «había empezado a molestar.»27

Mientras entrenaban, bautizaron los modelos intermedios con nombres de científicos (ada, babbage, curie, davinci) y cada uno caía, limpiamente, sobre la curva que las leyes de escalamiento predecían.14

No era esperanza. Era una cuenta atrás que se confirmaba en cada paso.

En junio de 2020, el modelo final de GPT-3 tenía 175.000 millones de parámetros. Para ubicarnos: la primera versión de ChatGPT se basaría en una iteración menor de este, GPT-3.5. Tom Brown firmó como autor principal del paper — probablemente el artículo de investigación más influyente de la última década en IA, junto a Ben Mann.22

GPT-3 podía escribir ensayos, mantener conversaciones que parecían humanas, traducir idiomas que nadie le había enseñado. Las leyes de escalamiento habían dejado de ser teoría. Altman las llamó “potencialmente el descubrimiento más importante del siglo veintiuno.”27

Amodei le dijo al New York Times que GPT-3 tenía “esa cualidad emergente”28 — una capacidad inesperada para reconocer patrones y completar historias. Lo celebró en público.

Pero en privado, fue precisamente ver GPT-3 funcionar lo que endureció su convicción de que la seguridad no podía seguir siendo secundaria. Porque ya sabía lo que un error podía hacer.

Un año antes, un investigador que aplicaba RLHF a un modelo posterior a GPT-2 cometió un error tipográfico antes de irse a casa.

Un carácter.

Ocurrió que introdujo un signo menos en lugar de un signo más, y el proceso de alineamiento se invirtió: en vez de empujar al modelo hacia contenido positivo, lo empujó en la dirección contraria.

A la mañana siguiente, el modelo completaba cada prompt con lenguaje explícitamente obsceno.

Solo un carácter y el sistema hizo exactamente lo contrario de lo que se pretendía.

Ahora los modelos eran cien veces más grandes. Y GPT-3 acababa de aprender algo que nadie le había pedido: a escribir código. Los datos de entrenamiento, rastreados de Reddit y Common Crawl, incluían fragmentos de programación publicados en foros, y el modelo los había absorbido sin que nadie lo planeara.

Para la división de producto, un hito con potencial comercial enorme.

Para la de seguridad, una señal de alarma. Si un sistema de IA podía escribir código, en teoría podía modificarse a sí mismo.

Juego de tronos

En algún momento de 2020, alguien en OpenAI pidió un presupuesto para blindar una sala de servidores contra disparos de ametralladora.

Esta idea se descartó, pero otras no.26

La empresa reforzó las puertas del edificio con teclados que incluían “contraseñas de coacción”, códigos que, al introducirse, activaban una alarma silenciosa en vez de abrir la puerta. Amodei usó al menos dos veces un ordenador desconectado de internet para redactar documentos estratégicos e imprimió copias físicas para distribuirlas: temía que actores estatales robaran los secretos de OpenAI.

“Nadie estaba preparado para esa responsabilidad”, recuerda un empleado. “Le quitaba el sueño a la gente.”26

La combinación de presión personal, profesional y milenarista se estaba tomando su precio.

No pasó por alto para Sam Altman. En un memo de visión de ese año identificó al menos tres clanes: Investigación Exploratoria, liderado por Ilya Sutskever (avance hacia la AGI). Seguridad, liderado por Dario Amodei (sortear el riesgo existencial). Startup, encarnado por Greg Brockman (lanzar producto primero e ir viendo después). “Tenemos que evitar la guerra tribal”, escribió.

Ya era tarde.

En torno a Amodei gravitaba un grupo que algunos llamaban los pandas 22 — por su debilidad por el animal.

Jack Clark temía la “captura industrial”: que la inversión de Microsoft hubiera convertido a OpenAI en una extensión corporativa con fachada de interés público.

Chris Olah chocaba con la dirección por la falta de recursos para interpretabilidad.

Amodei canalizaba la frustración en prolíficos memos internos donde distinguía entre “empresas M” (orientadas al mercado) y “empresas P” (orientadas al bien público), su forma de nombrar lo que quería que OpenAI fuese y en lo que temía que se estuviera convirtiendo.

Sus memos dividían opiniones. Algunos colegas2 los percibían como inspiradores, y otros como una forma de plantar banderas para reclamar territorios intelectuales.

Lo que unía a los pandas era un diagnóstico compartido: la carrera por escalar había dejado atrás cualquier pretensión seria de seguridad. Y lo que acabó de radicalizarlos fue lo que descubrieron tras el acuerdo con Microsoft: el alcance de lo que Altman había prometido a cambio de la inversión. Acceso a tecnologías que no se habían consensuado.

Si surgían problemas de seguridad, esos compromisos harían mucho más difícil frenar el despliegue.

“Somos gente pragmática”, recuerda alguien del grupo. “Sabíamos que iba a haber cosas comerciales. Pero estábamos entregando algo que no entendíamos del todo. Nos dejaba en un lugar incómodo.”26

Amodei no se lo callaba. “Hacemos IA para la humanidad, pero al mismo tiempo nos convertimos en proveedor tecnológico de una empresa que intenta maximizar beneficios”, les señalaba a sus compañeros.30

Altman envió a Reid Hoffman a mediar (inversor, eterno optimista y miembro del consejo de Microsoft). “Esta es la forma en que cumplimos la misión”, les explicó Hoffman.

Pero los Amodei no se dejaron convencer. Los modelos eran cada vez más grandes e inesperados, y Hoffman, al fin y al cabo, tenía asiento en el consejo de Microsoft. ¿Qué iba a decir?30

Pero la rivalidad con Brockman venía de mucho antes que Microsoft.

Cuando Musk dejó OpenAI a principios de 2018, Altman tomó el mando. Se reunió con Amodei, y coincidieron en que los empleados habían perdido la confianza en Brockman y Sutskever tras los despidos. Amodei accedió a quedarse con una condición: que ninguno de los dos estuviera al mando.

Altman aceptó.38

Poco después, en una reunión sobre la estructura interna, Brockman mencionó de pasada que Altman les había prometido a él y a Sutskever que podrían despedirlo si alguna vez creían que lo estaba haciendo mal.38

La tensión estalló con el proyecto de lenguaje.

Cuando Alec Radford sentó las bases de los grandes modelos de lenguaje y la serie GPT, Brockman quiso participar. Daniela, que dirigía el proyecto junto a Radford, se negó. Cuando Altman le pidió que buscara la forma de incluirlo, ofreció dejar la dirección del proyecto antes que aceptarlo en el equipo.38

En una reunión posterior, Dario enumeró las razones por las que Brockman debía mantenerse lejos, incluido que Radford se negaba a trabajar con él. Radford quedó atrapado en medio: sus preferencias privadas convertidas en munición entre ejecutivos.38

Amodei no siempre sentía que su peso se reflejara en el trato. En 2018, Brockman le pidió que verificara un dato en unas diapositivas. «¿Para qué son?» «Vamos a reunirnos con Obama.» Nadie le había avisado.38 Le irritaba que Brockman apareciera en podcasts hablando de la carta fundacional de la empresa cuando él había contribuido más a redactarla.

En 2019 pidió un ascenso a vicepresidente de investigación. Altman aceptó y notificó al consejo que reportaría directamente a él y recibiría el mismo tratamiento público que Brockman y Sutskever. El email incluía una condición: Amodei se comprometía a «no denigrar proyectos en los que no creyera y que otros quisieran apostar».38

La tregua duró meses.

La tensión entre Amodei y Sutskever (que compartían la dirección de investigación29 pero con prioridades opuestas) era menos personal que la rivalidad con Brockman, pero más profunda.

La pandemia y el trabajo remoto agudizaron todas las fracturas.26

Amodei despriorizó Dota 2, el proyecto estrella de Brockman, y centralizó el cómputo en Nest. Sutskever montó un equipo para generar código y descubrió que Amodei ya tenía el suyo en marcha. La lógica era siempre la misma: construir el modelo más rápido que nadie (incluidos otros equipos dentro de OpenAI) y usar la ventaja para investigar cómo hacerlo seguro. Las iniciativas duplicadas siguieron adelante.26

Cuando llegó la planificación de GPT-3, la historia se repitió. Brockman quiso participar. Amodei respondió que ni hablar.

Delante de Altman, Murati y una sala llena de directivos, repitió los argumentos del proyecto de lenguaje y añadió uno: que Brockman tenía fama de irrumpir en proyectos ajenos y acapararlos (fama justificada, Altman “invitaría” a Brockman años más tarde a tomarse unas vacaciones de OpenAI para calmar el malestar de los empleados contra él).

Altman decidió dejar a Brockman fuera de GPT-3 para preservar la relación con Amodei y Radford. El resto de la empresa quedó atónito ante la influencia de Amodei, y vio en aquello el inicio de una fractura irreversible.27

Lo que se supo después fue peor.

En su deposición en Musk v. Altman31, Sutskever testificó que Amodei no solo quería apartar a Brockman de GPT-3: quería que lo despidieran de OpenAI.

Sutskever también culpó a Altman de «enfrentar a sus ejecutivos unos contra otros.» Y tenía pruebas: Mira Murati le había mostrado capturas de pantalla donde Altman la enfrentaba a ella contra Daniela Amodei.

Se sembraban las semillas del golpe que, tres años más tarde, casi destruiría la empresa.

“Desde fuera, parecía una especie de locura tipo Juego de Tronos“, dijo un investigador.26

Desde dentro, también. Este era el caldo humano en el que se gestaba la mayor revolución tecnológica de este siglo.

Adiós

El punto de ruptura

Lo que más desgastaba no era la confrontación. Era su ausencia.

La respuesta a cada propuesta de seguridad nunca fue un “no”. Fue algo peor: un “sí, pero”. El estilo de gestión de Sam Altman, minaba la paciencia de Amodei, pero con el paso de los años, de manera manejable para Altman.

Sí, la seguridad importa, pero ahora mismo hay que enviar producto. Sí, la interpretabilidad es interesante, pero los recursos son limitados. Sí, tienes razón en teoría, pero en la práctica hay prioridades.

Cada decisión sobre Microsoft, sobre GPT-3, sobre gobernanza o despliegue se presentaba como abierta al debate, pero llegaba ya cerrada34. Se escuchaban las objeciones, se asentía, y nada cambiaba. Para cuando los disidentes descubrían que no tenían voz, ya era demasiado tarde.26

Un episodio de principios de 2020 condensó ese patrón de Altman:

Altman citó a Dario y Daniela en una sala de reuniones y los acusó de conspirar contra él animando a compañeros a enviar evaluaciones negativas al consejo.

Los hermanos lo negaron.

Altman dijo que se lo había contado otra ejecutiva de la cúpula. Daniela la hizo venir a la sala. La ejecutiva dijo que no sabía de qué hablaba Altman.

Altman negó haberlo dicho, y los Amodei acabaron gritándole.38

En marzo, las relaciones estaban tan deterioradas que Altman pidió a los ejecutivos que se evaluaran mutuamente por escrito.

Brockman redactó una crítica extensa de Daniela: la acusaba de abusar de su posición para imponer procesos burocráticos a su conveniencia. Se la mostró a Altman antes de entregarla. Altman la calificó de «dura pero justa». Daniela respondió con una refutación punto por punto. La pelea sobre las propias evaluaciones se volvió tan intensa que Brockman acabó ofreciendo retirar la suya.38

Años después, Amodei hablaría de aquella erosión. La historia cambió según el micrófono.

En el podcast de Lex Fridman32, la versión fue quirúrgica: “Si tienes una visión de cómo hacerlo, deberías irte y ejecutar esa visión. Es increíblemente improductivo intentar discutir con la visión de otra persona.” Intentó discutir durante cuatro años y acabó eligiendo irse.

En el Big Technology Podcast2 de Alex Kantrowitz, la diplomacia cedió. Cuando le preguntaron por qué había fundado una empresa propia, respondió que en las anteriores nunca sintió que la misión fuera en serio. Que construir IA que beneficiase a la humanidad se había convertido en un reclamo: “Había una narrativa que se usaba frecuentemente para reclutar, pero con los años me quedó claro que no era sincera”. Y sobre el liderazgo: “Si trabajas para alguien cuyas motivaciones no son sinceras, que no es una persona honesta, que no quiere de verdad hacer del mundo un lugar mejor, no va a funcionar.”

Nunca nombró a Sam Altman. Nunca hizo falta.

Su hermana Daniela Amodei, que había llegado a OpenAI en 2018 y acabó dirigiendo Safety & Policy8, siempre fue más contenida. Para ella, la salida fue cuestión de “diferencias de dirección, no de conflictos personales”33.

Pero las versiones públicas tenían un límite. Lo que Karen Hao reconstruye en Empire of AI (Penguin Press, 2025) a partir de fuentes internas lo cruza. En privado, Dario, Daniela y su círculo tenían otra palabra para las tácticas de Altman: gaslighting26. Manipulación emocional. Abuso psicológico. Hagey lo confirma: Amodei les decía a sus amigos que se sentía maltratado por Altman27.

Amodei se marchaba para hacer seguridad como él la entendía. Pero esa definición de seguridad tenía un punto ciego, y quienes lo señalaron no venían del bando comercial.

En 2020, Inioluwa Deborah Raji y Roel Dobbe publicaron una respuesta directa al paper fundacional de Amodei35. Amodei ilustraba los riesgos de la IA con un ejemplo célebre: un robot de limpieza que tira un jarrón por accidente. Su seguridad empezaba después de que el modelo existiera.

Raji y Dobbe miraron un paso antes. Para que ese robot existiera, alguien había violado la privacidad de millones de personas al compilar los datasets de entrenamiento. Alguien había pagado a anotadores precarios para etiquetar contenido perturbador. Alguien había asumido el coste ambiental del cómputo a escala. Los llamaron daños de producción: una categoría que la taxonomía de Amodei ni contemplaba.

Dentro de OpenAI, varias investigadoras presionaron para ampliar la definición de seguridad. La respuesta de los ejecutivos fue de cinco palabras: “Ese no es nuestro rol.”8

La grieta no era menor. Definía qué clase de seguridad llevaría Amodei a Anthropic — y cuál dejaría atrás.

La del riesgo existencial. No la del daño cotidiano.

Para Amodei el desarrollo de la Inteligencia Artificial era inevitable, y él tenía que adelantarse para encauzarla por el buen camino, no se podía desinventar.

La decisión

De pronto, el grupo interno de Amodei en Slack se quedó en silencio.

No se despidió nadie ni se anunció nada. Mientras GPT-3 convertía a OpenAI en la empresa de IA más comentada del mundo y Microsoft negociaba otros 2.000 millones, el canal donde Dario y su círculo habían debatido durante meses dejó de tener actividad.

Dario tanteó primero a Kaplan, coautor de las leyes de escalamiento, la persona que mejor entendía la curva y lo que significaba. Después a su hermana Daniela. Después a Clark. Uno por uno, en conversaciones privadas, fue reuniendo a un grupo reducido de investigadores dispuestos a marcharse.

La ironía era precisa: su propia investigación les imponía la fecha límite.

Las leyes de escalamiento significaban que entrenar un modelo de primera categoría iba a costar más cada trimestre. La ventana para montar un competidor se cerraba y ellos mismos habían dibujado la curva que lo demostraba. “Si queríamos irnos y hacer algo, estábamos contra reloj”, recuerda uno de los que se fueron.26

A finales de 2020, OpenAI convocó una reunión general por videollamada. Pandemia, Zoom, caras en cuadrícula. Altman le pasó el micrófono a Dario.

No improvisó. Leyó una declaración preparada anunciando que él, Daniela y varios otros se marchaban a fundar su propia empresa.

Altman pidió a todos los que renunciaban que abandonaran la reunión.26

En mayo de 2021 la nueva empresa tenía nombre: Anthropic, una public benefit corporation. Siete cofundadores y unos catorce investigadores más. No se fueron los becarios, sino el equipo titular al completo. Altman, según quienes lo rodeaban, nunca se recuperaría del todo.27

Parmy Olson señala en Supremacy (St. Martin’s Press, 2024) que Amodei había visto de primera mano cómo Altman negociaba mil millones con Microsoft, y podía intuir que había más capital disponible para quien quisiera competir. “Incluso entre los más preocupados por la IA”, escribe, “había oportunismo.”30

Hao llega a una conclusión parecida pero más precisa: “Tanto como Amodei estaba motivado por el deseo de hacer lo correcto dentro de sus principios, también quería mayor control del desarrollo de la IA para perseguirlo según sus propios valores e ideología.”26 La diferencia importa: Olson ve cálculo, Hao ve convicción y ambición ocupando el mismo cuerpo.

No hace falta elegir. Quienes más sabían sobre lo que GPT-3 podía hacer (porque lo habían construido) fueron los primeros en alarmarse. No un filósofo, ni un senador o un columnista: los ingenieros que habían visto de cerca lo que las curvas prometían.

Pero al publicar esas curvas, Kaplan, McCandlish y Amodei habían dibujado el mapa para todo el mundo. Cualquiera con recursos suficientes podía seguirlo, y toda la industria empezó a hacerlo. Nadie tenía un plan para lo que encontraría al final del trayecto.

La ruptura dejó marca en Dario Amodei. En las reuniones de Anthropic, a menudo puntuaría las actualizaciones con la coletilla “a diferencia de Sam” o “a diferencia de OpenAI”.26

Y tendría un epílogo revelador.

Tres años después, en noviembre de 2023, la junta de OpenAI destituyó brevemente a Altman. Y en medio de esos cinco días de caos, el propio consejo contactó a Amodei para proponerle algo improbable: reemplazar a Altman y fusionar las dos empresas.36 Pero de eso hablaremos en el próximo artículo.

La nueva casa

El nombre —del griego anthropos, orientado a lo humano— se eligió2 de una lista que incluía Aligned AI, Sponge, Swan, Sloth y Sparrow Systems. En la hoja de cálculo del equipo, alguien escribió junto a la opción ganadora: “nos gusta, es bueno” (y además tenía el dominio disponible).

En sus primeros meses, la empresa era poco más que una veintena de personas en plena pandemia. Se juntaban por Zoom y, cuando el tiempo lo permitía, en almuerzos semanales en Precita Park, cada uno con su propia silla plegable. No había oficina. Tampoco había producto, ni un solo dólar de ingresos.

Lo que había era lo que uno de los presentes describió como un “sentido de destino”, y cuando lo decía no hablaba en metáfora.

Todos en aquel parque habían visto lo mismo desde dentro de OpenAI: las curvas no se iban a detener. Los modelos iban a seguir creciendo, iban a seguir mejorando, y nada en el horizonte sugería un techo. En eso podía coincidir cualquier laboratorio del mundo.

La diferencia estaba en lo que seguía.

Si un modelo el doble de grande era el doble de capaz, ¿era también el doble de seguro? Para todos los que almorzaban en Precita Park, la respuesta era no. Un modelo más grande no era, por el hecho de serlo, un modelo más seguro. Había que construir la seguridad con el mismo rigor y los mismos recursos que se dedicaban a las capacidades, o no se construía en absoluto.

Esa convicción era la razón por la que almorzaban en un parque en vez de cobrar stock options en la empresa de IA más valiosa del mundo.

En los dos años siguientes, el resto de la industria confirmaría la primera mitad de esa tesis con entusiasmo y trataría la segunda como un adorno. Google publicó el modelo PaLM: 540.000 millones de parámetros. Meta lanzó LLaMA sin red teaming (revisión de seguridad) externa. Todos asentían educadamente ante la idea de que la seguridad importaba, y dedicaban el grueso de sus recursos a hacer modelos más grandes.

Anthropic prometía invertir la ecuación y algo más.

Que su ejemplo arrastraría al resto. Que si demostraban que se podían construir modelos seguros y ganar dinero con ellos, los competidores tendrían que igualar ese estándar o perder credibilidad. Una carrera hacia arriba, no hacia abajo.

Esa era la apuesta que se hacía desde unas sillas plegables en un parque de San Francisco.

Cinco años después, mientras escribo esto en marzo de 2026, Anthropic vale 380.000 millones de dólares.37 Su modelo Claude domina un tercio del mercado empresarial y genera catorce veces más ingresos que en 2024.

Y, sin embargo, ninguno de esos números es lo que ocupa los titulares.

Lo que ocupa los titulares es que la administración Trump la ha declarado riesgo para la cadena de suministro (una etiqueta que hasta ahora solo llevaban empresas vinculadas a adversarios extranjeros).

Que el compromiso fundacional de pausar el desarrollo si la seguridad no podía seguir el ritmo ya no existe.

Y que la empresa que nació para demostrar que se podía construir la tecnología más potente del mundo sin soltar las riendas ahora demanda al gobierno de Estados Unidos invocando la Primera Enmienda.

La distancia entre unas sillas plegables en Precita Park y una demanda federal no se mide en años. Se mide en decisiones.

En los próximos artículos recorreremos cada una de ellas.

Notas

Jared Kaplan et al., “Scaling Laws for Neural Language Models,” arXiv (2020).

Alex Kantrowitz, “The Making of Dario Amodei,” Big Technology.

Dario Amodei, entrevista, Future of Life Institute.

Hertz Thesis Prize, Hertz Foundation.

Dario Amodei et al., “Deep Speech 2: End-to-End Speech Recognition in English and Mandarin,” arXiv (2015).

Keach Hagey, The Optimist (W. W. Norton, 2025), cap. 11: “A Manhattan Project for AI.”

Parmy Olson, Supremacy (St. Martin’s Press, 2024), cap. 6: “The Mission.”

Karen Hao, Empire of AI (Penguin Press, 2025), cap. 2: “A Civilizing Mission.”

Dario Amodei et al., “Concrete Problems in AI Safety,” arXiv (2016).

Jack Clark y Dario Amodei, “Faulty Reward Functions in the Wild,” OpenAI (2016).

Dario Amodei, entrevista, 80,000 Hours (2017).

Future of Life Institute, Beneficial AI Conference (enero 2017).

Paul Christiano et al., “Deep Reinforcement Learning from Human Preferences,” arXiv (2017).

Karen Hao, Empire of AI (Penguin Press, 2025), cap. 5: “Scale of Ambition.”

Daniel Ziegler et al., “Fine-Tuning Language Models from Human Preferences,” arXiv (2019); Nisan Stiennon et al., “Learning to Summarize from Human Feedback,” NeurIPS (2020); Geoffrey Irving y Dario Amodei, “AI Safety via Debate,” arXiv (2018); Paul Christiano et al., “Supervising Strong Learners by Amplifying Weak Experts,” arXiv (2018).

Dwarkesh Patel, podcast con Dario Amodei (2024).

Dario Amodei, “The Urgency of Interpretability” (2025).

Consejo de Estado de la República Popular China, “Plan de Desarrollo de Inteligencia Artificial de Nueva Generación” (新一代人工智能发展规划), julio de 2017. Traducción al inglés por Graham Webster et al., DigiChina, Stanford Cyber Policy Center.

Dwarkesh Patel, The Scaling Era (2025), Conclusion.

Dwarkesh Patel, entrevista con Dario Amodei (2026).

Danny Hernandez y Tom Brown, “AI and Compute,” OpenAI (2018).

“Anthropic,” Contrary Research.

Sam McCandlish, Jared Kaplan y Dario Amodei, “An Empirical Model of Large-Batch Training,” arXiv (2018).

Jack Clark, testimonio ante el Comité de Ciencia de la Cámara (junio 2019).

Karen Hao, “The Messy, Secretive Reality behind OpenAI’s Bid to Save the World,” MIT Technology Review (febrero 2020). El email de Altman reportado en Hagey, The Optimist.

Karen Hao, Empire of AI (Penguin Press, 2025), cap. 6: “Ascension.”

Keach Hagey, The Optimist (W. W. Norton, 2025), cap. 14: “Products.”

Cade Metz, “Meet GPT-3. It Has Learned to Code (and Blog and Argue),” The New York Times (noviembre 2020).

OpenAI, “Organizational Update,” (2020).

Parmy Olson, Supremacy (St. Martin’s Press, 2024), cap. 11: “Bound to Big Tech.”

Deposición de Ilya Sutskever en Musk v. Altman (2025), vía Zvi Mowshowitz.

Lex Fridman, Podcast: Dario Amodei.

Ainsley Harris, “How Anthropic’s Daniela Amodei Is Keeping AI Grounded in Safety,” Fast Company (2023).

“Anthropic-OpenAI Feud,” Fortune (2026).

Inioluwa Deborah Raji y Roel Dobbe, “Concrete Problems in AI Safety, Revisited,” ICLR Workshop on ML in the Real World (2020).

“The Memo That Shook OpenAI,” Mastermind Newsletter.

Gene Dai, “Dario Amodei: Anthropic CEO & AI Safety Pioneer” (2025); “Anthropic: The Business Logic of AI Safety First” (2026).