Ha pasado un año desde la última entrada en este Substack. Un año que, como suele ocurrir en el campo de la mal llamada Inteligencia Artificial, se siente como cinco, y en el que la “ceguera al futuro” que comenté el año pasado, ha venido para quedarse. Antes de retomar Substack con cosas nuevas, quisiera reincidir en esa ceguera, porque ahora ya no es sólo una sensación: es el terreno en el que nos movemos.

Las predicciones que no fueron

La proyección desde mayo de 2024 hasta mayo de 2025, al menos la que circulaba a pie de calle en las comunidades de IA en redes sociales, pintaba un panorama de meseta tecnológica. Los gurús que no se dejaban arrastrar por el hype “AGI” hablaban de un avance lento, casi perezoso, de los modelos de lenguaje. El argumento parecía sólido: nos estábamos quedando sin datos nuevos para alimentarlos, y su tamaño ya rozaba lo prohibitivo. "Los LLMs han chocado contra un muro", repetían los más pesimistas, con esa satisfacción extraña que produce anunciar el fin de algo revolucionario.

Las predicciones eran cautelosamente conservadoras: progresiva eficiencia en los modelos existentes, mejoras incrementales en generadores de imágenes como Midjourney, y tal vez —sólo tal vez— aparecería un nuevo modelo insignia de OpenAI con un número de parámetros tan astronómico que su uso sería un lujo de unas pocas consultas diarias en los plantes de pago. Los modelos de vídeo seguirían siendo juguetes caros de empresas como OpenAI, que nos había dejado boquiabiertos en febrero con Sora pero que parecía más una demostración tecnológica que un producto real. Y los "agentes autónomos"... bueno, esos permanecerían en ese limbo conceptual donde habitan las promesas tecnológicas que siempre están a dos años vista.

Por supuesto, la realidad tenía otros planes.

El despertar de los titanes

En junio de 2024, Anthropic lanzó Claude Sonnet 3.5. No fue un salto espectacular en términos de benchmarks —de utilidad decreciente, hay que decir—, pero revolucionó la generación de código. De pronto, programadores de todo el mundo descubrían que podían delegar tareas complejas a un asistente que no solo entendía su intención, sino que podía llegar a escribir código aceptablemente limpio, eficiente y, también (sorprendente cuando salió): bien documentado.

Este es uno de esos fenómenos que se suelen infravalorar cuando hablamos del progreso en IA: pequeños aumentos en capacidad de "razonamiento" pueden desbloquear aplicaciones completamente nuevas. Aunque las mejoras parezcan discretas y lineales sobre el papel, sus consecuencias en el mundo real pueden ser exponenciales.

Anthropic no se durmió en los laureles. Las versiones posteriores —3.7 y más recientemente 4.0— continuaron empujando los límites, especialmente en tareas que requieren razonamiento complejo y generación de código. La competencia se intensificó, pero Anthropic mantuvo su ventaja en este nicho crucial que está transformando cómo se desarrolla software a nivel global.

La era del razonamiento

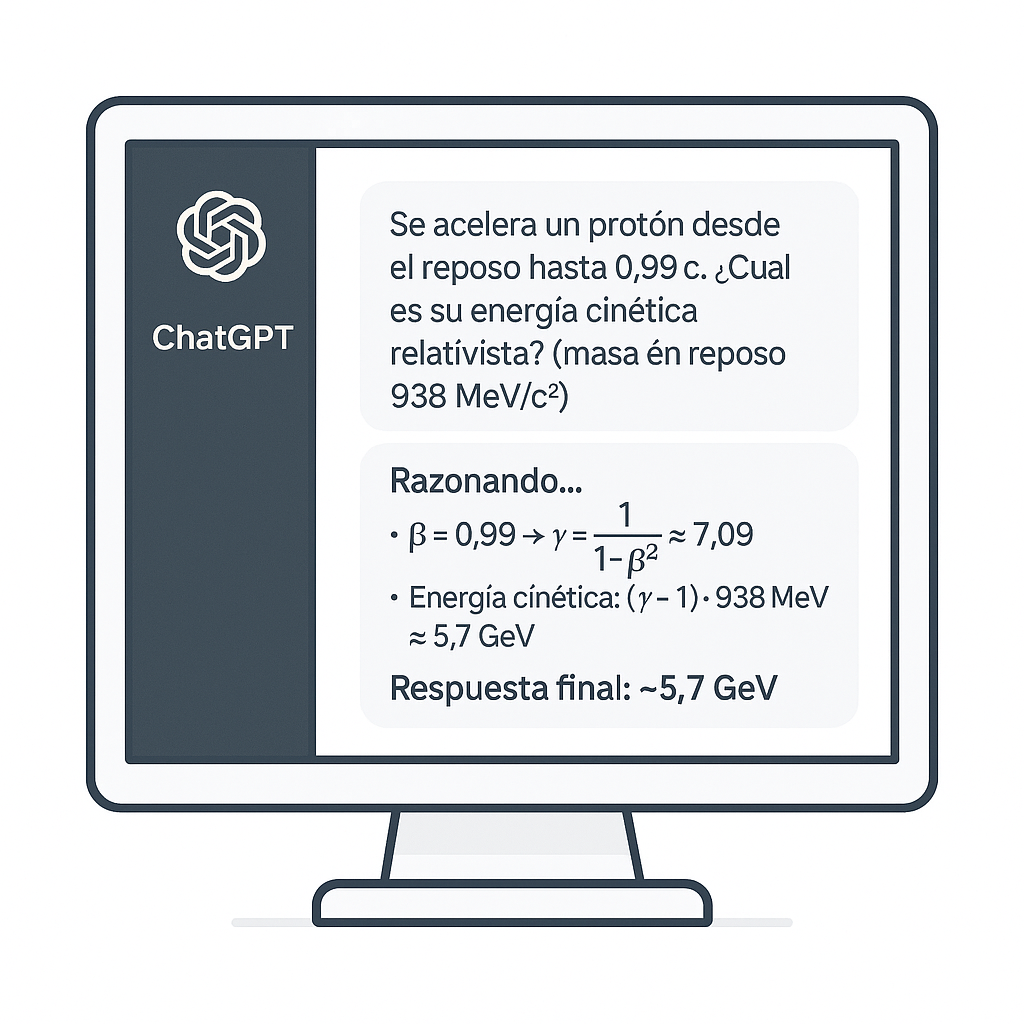

Pero el verdadero cambio de paradigma llegó en septiembre con o1-preview de OpenAI. Este modelo representaba algo fundamentalmente diferente: la primera generación de lo que ahora llamamos modelos "razonadores". La idea era elegante en su simplicidad y brutal en su eficacia: si le das más tiempo a un modelo para "pensar" durante la inferencia, puede llegar mucho más lejos que simplemente escupiendo la primera respuesta que se le ocurre.

La industria reaccionó con la velocidad que la caracteriza. En cuestión de meses, todos los principales laboratorios tenían sus propias versiones de modelos razonadores. El más reciente, o3 de OpenAI, muestra un rendimiento que hace apenas un año habríamos considerado imposible sin un salto generacional en la arquitectura subyacente.

La fruta fácil de coger, a nivel del suelo, se acabó, dijo Sundar Pichai hace meses refiriéndose a mejorar los modelos de lenguaje simplemente inflándolos con más datos. Pero como demuestran los modelos razonadores o los más recientes modelos de lenguaje de difusión, cualquier grieta, cualquier alternativa, cualquier posible promesa o ramificación de avance, va a recibir el impacto de un ariete de cientos de millones de dólares.

Eso no hay muro que lo aguante.

El gigante despierta

Durante años, Google parecía estar durmiendo mientras startups como OpenAI y Anthropic acaparaban titulares. Gemini, su apuesta en IA, era vista como un intento tardío y poco inspirado de subirse al tren.

Sin embargo, en los últimos seis meses los modelos Gemini evolucionaron a una velocidad vertiginosa. Gemini 2.5 Pro ya compite de tú a tú con lo mejor de OpenAI y Anthropic. Y lo más reseñable: Google lo está haciendo sin grandes sufrimientos técnicos o logísticos. Tienen la infraestructura, el talento, y sobre todo, no tienen que mendigar chips a NVIDIA como el resto. Pueden ser más agresivos en precios, más ambiciosos en escala, y más pacientes en su estrategia.

Todas las bromas y las humillaciones desde 2022, han quedado enterradas.

La popularización del poder computacional

En julio de 2024, Meta soltó una bomba: Llama 3.1. Por primera vez en la historia, un modelo de código abierto alcanzaba el nivel de GPT-4, el estándar de oro comercial. Era como si alguien hubiera publicado los planos para construir un Ferrari en tu garaje. La comunidad técnica, acostumbrada a recibir migajas en forma de modelos aligerados o versiones castradas de los grandes LLMs, no podía creer lo que estaba viendo. De repente, empresas emergentes sin acceso a las costosas APIs de OpenAI podían construir productos competitivos. Investigadores en universidades con presupuestos ajustados podían experimentar con tecnología punta.

Por primera vez en la corta historia de los modelos de lenguaje, el terreno de juego se había nivelado parcialmente.

Y entonces llegó DeepSeek. En enero de 2025, esta empresa china relativamente desconocida publicó DeepSeek R1, acercando la revolución de los modelos razonadores al código abierto. Si Llama 3.1 había democratizado los LLMs tradicionales, DeepSeek R1 hacía lo mismo con la siguiente generación. Era como si la historia se acelerara: lo que había tardado años en llegar al código abierto ahora sucedía en meses.

De Will Smith comiendo espaguetis de plastilina a Hollywood en casa

El sector de generación de vídeo merece su propio documental sobre transformación acelerada. Hace apenas dos años, nos partíamos de risa viendo aquella infame creación de IA donde Will Smith parecía fusionarse molecularmente con un plato de pasta. Era grotesco, surrealista, y sobre todo, una prueba clara de que la IA no entendía cómo funcionaba el mundo físico.

Si avanzamos hasta 2025, la situación es irreconocible.

Runway Gen-2 fue el primero en cruzar el umbral de "utilizable profesionalmente". De repente, pequeños estudios de producción podían generar tomas que habrían requerido presupuestos de cinco cifras. Pero fue la avalancha de iniciativas chinas —p.e Kling— las que verdaderamente democratizaron el medio. Cualquiera podía generar vídeos que habrían sido imposibles sin un equipo completo de efectos especiales, por el precio de un café de marca.

OpenAI finalmente lanzó Sora en diciembre, pero el producto final era inferior a la demostración que habían mostrado en febrero (básicamente porque no tienen el ancho de banda computacional necesario para servirlo a gran escala). Mientras tanto, Google, en su nueva faceta de "gigante despierto", lanzó Veo 2 y se llevó la corona. Y no contentos con eso, hace apenas unos días presentaron Veo 3, que no sólo genera vídeo fotorrealista, sino que añade voz, efectos de sonido y música.

La sinfonía de las máquinas

El audio ha seguido una trayectoria paralela pero igualmente impresionante. Suno y Udio, los dos principales contendientes en generación musical, han alcanzado un nivel donde solo un oído entrenado puede distinguir sus creaciones de una producción profesional.

Pero lo verdaderamente inquietante y fascinante es la facilidad con la que ahora podemos manipular la realidad auditiva. Con 15 segundos de muestra de voz —un audio cualquiera de WhatsApp— cualquiera puede clonar una voz con fidelidad escalofriante. Los montajes de vídeo han evolucionado hasta el punto de poder tomar un vídeo de alguien diciendo algo y transformarlo en un vídeo de esa misma persona diciendo algo completamente diferente, con sincronización labial perfecta y su propia voz.

Y luego está el elefante conversacional en la habitación: el modo de voz de ChatGPT. La película "Her" pasó de ser ciencia ficción anticipatoria a documental histórico en tiempo récord.

Los nuevos bibliotecarios

Quizá uno de los desarrollos más profundos pero menos llamativos ha sido la evolución de las herramientas de investigación impulsadas por IA. OpenAI, Google y Anthropic han desarrollado sistemas Deep Research que no sólo buscan información, sino que la sintetizan, la contrastan y la presentan en informes coherentes con fuentes citadas.

Para investigadores académicos, periodistas, analistas de mercado —cualquiera cuyo trabajo implique sintetizar información compleja— el aumento de productividad es difícil de exagerar.

Caminando en la oscuridad

Y aquí estamos. En menos de tres años desde que ChatGPT irrumpió en la conciencia colectiva, hemos visto más transformación digital que en los quine anteriores. La aceleración no muestra signos de frenarse; si acaso, parece aumentar aún más.

Pero esto es solo una parte de la historia. La locura del avance tecnológico se está fusionando con una incertidumbre geopolítica sin precedentes. Como comentaba recientemente un analista estadounidense: "En tres meses del nuevo mandato de Trump, el orden mundial ha cambiado más que en los últimos 30 años". No es hipérbole; es la nueva normalidad donde los ejes tecnológicos, políticos y económicos giran a velocidades que desafían nuestra capacidad de asimilación.

La paradoja de la predicción

Esta “ceguera ante el futuro" es un escenario inédito en la historia moderna. Durante la mayor parte del siglo XX y principios del XXI, podíamos hacer proyecciones razonables en lustros o incluso décadas. Sabíamos, más o menos, cómo sería un automóvil en diez años, qué tipo de mejoras esperaríamos en los ordenadores, cómo evolucionarían las ciudades.

Ahora, hacer predicciones a seis meses es un ejercicio de ficción especulativa.

Hasta las posturas emocionales básicas —optimismo y pesimismo— se han vuelto absurdas en su simplicidad. Ambas presuponen que podemos predecir hacia dónde nos dirigimos, cuando la realidad es que navegamos en una niebla tan densa que no podemos ver más allá de nuestras narices. Por supuesto, el instinto humano nos empuja a prepararnos para lo peor —más vale prevenir que curar—, pero incluso nuestros escenarios más pesimistas tienen pies de barro en su certeza.

Los relatos estáticos y certeros son reconfortantes. Nos gusta creer que entendemos lo que viene, que tenemos un mapa del territorio. Pero estos mapas son, en el mejor de los casos, autoengaños benignos. En el peor, pueden ser peligrosamente desorientadores y paralizantes: hacer buen uso de esta tecnología me parece más eficaz para prevenir los malos usos que limitarse a fantasear sobre ellos o esperar a que se desinvente.

En territorio desconocido

Y así, nos adentramos en territorio verdaderamente inexplorado. No es sólo que la tecnología esté avanzando deprisa; es que está redefiniendo las reglas del juego mientras lo jugamos.

La imagen que me viene a la mente es la de caminar en una noche sin luna, alumbrando apenas un par de metros de suelo frente a nosotros con una pequeña linterna. No sabemos si el siguiente paso nos llevará a un jardín o a un precipicio. No podemos ver el horizonte, mucho menos el destino.

La tentación es detenerse y esperar a que amanezca. Pero el viejo mundo ya no va a amanecer de nuevo. El cambio es la única constante, y la adaptabilidad, la única estrategia viable.

La alternativa a la parálisis o a acabar en una zanja es mantener el paso firme pero prudente. Observar cuidadosamente esos dos metros iluminados frente a nosotros. Reaccionar con agilidad a lo que aparece en nuestro pequeño círculo de luz. Y, sobre todo, resistir la tentación de imaginar monstruos en la oscuridad que nos rodea, porque esa imaginación puede robarnos la atención que necesitamos para navegar el presente.

No sabemos qué nos espera en la oscuridad.